Du kannst dein Gesicht nicht ändern: Warum biometrische Daten ein dauerhaftes Sicherheitsrisiko sind

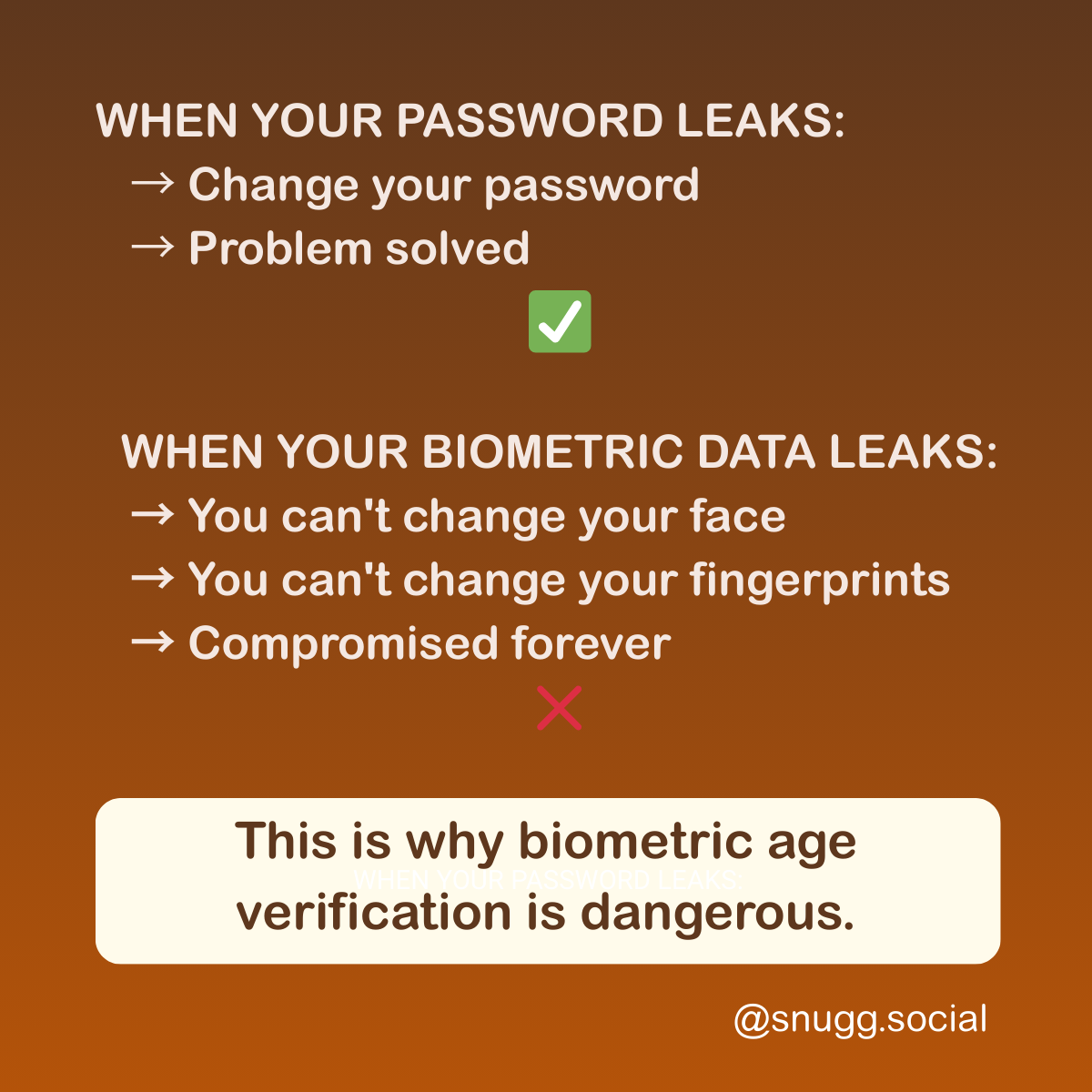

Wenn dein Passwort geleakt wird, änderst du es. Wenn deine biometrischen Daten geleakt werden, bist du für immer kompromittiert.

Letzte Woche habe ich etwas in sozialen Medien gepostet.

Eine einfache Nachricht über biometrische Daten. Darüber, was passiert, wenn Passwörter geleakt werden, im Vergleich zu dem, was passiert, wenn dein Gesicht geleakt wird.

Über 1.000 Menschen haben es geteilt.

Das ist nicht normal für meine Posts. Aber dieser hat etwas getroffen.

Wenn dein Passwort geleakt wird:

→ Ändere dein Passwort

>→ Problem gelöst

Wenn deine biometrischen Daten geleakt werden:

→ Du kannst dein Gesicht nicht ändern

→ Du kannst deine Fingerabdrücke nicht ändern

→ Die Kompromittierung ist dauerhaft

→ Für immer in Breach-Datenbanken

Es hat Resonanz gefunden, weil es wahr ist.

Aber ein Problem zu teilen reicht nicht aus. Wir müssen verstehen, womit wir es hier eigentlich zu tun haben.

Die Sache mit Gesichtern

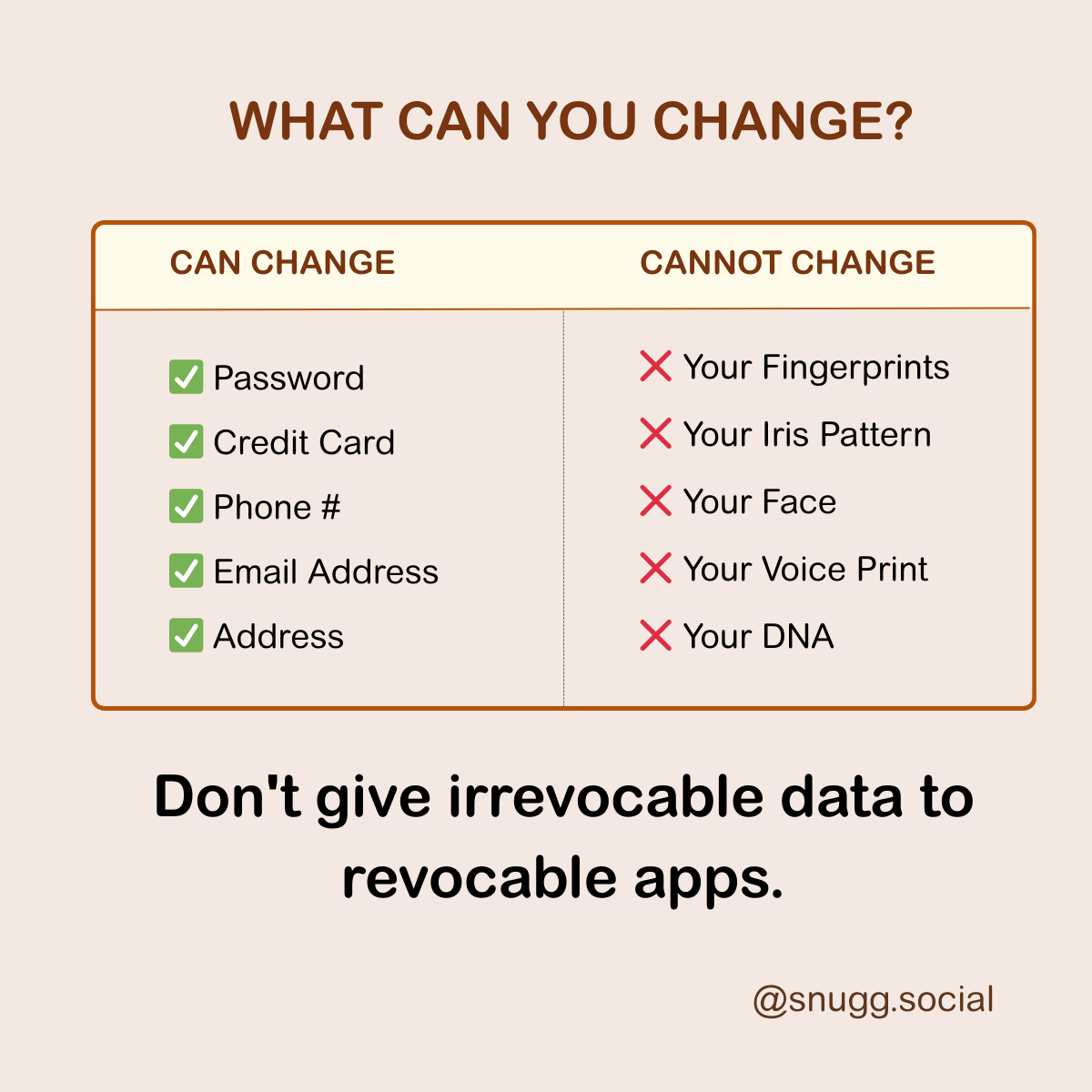

Denk an jede Anmeldeinformation, die du online verwendest.

Dein Passwort wird geleakt? Nervig, aber du änderst es. Problem gelöst.

Deine Kreditkarte wird gestohlen? Du sperrst sie, bekommst eine neue. Erledigt.

Deine E-Mail wird kompromittiert? Du erstellst eine neue Adresse. Weiter geht's.

Deine Telefonnummer wird offengelegt? Neue Nummer holen. Geregelt.

Sogar deine Wohnadresse — wenn es wirklich ein Problem wird, kannst du umziehen.

Aber dein Gesicht?

Dein Gesicht ist die einzige Anmeldeinformation, die du nicht ändern, rotieren oder widerrufen kannst.

Es ist du. Für immer.

Wenn eine Passwort-Datenbank gehackt wird, ändern alle ihre Passwörter. Wenn eine biometrische Datenbank gehackt wird, behält jeder das gleiche Gesicht.

Dauerhafte Exposition.

Deshalb ist die verpflichtende Gesichtserkennung zur Altersverifikation nicht nur ein Datenschutzproblem. Es ist eine Sicherheitskatastrophe, die nur darauf wartet zu passieren.

"Aber biometrische Datenbanken sind sicherer"

Wirklich?

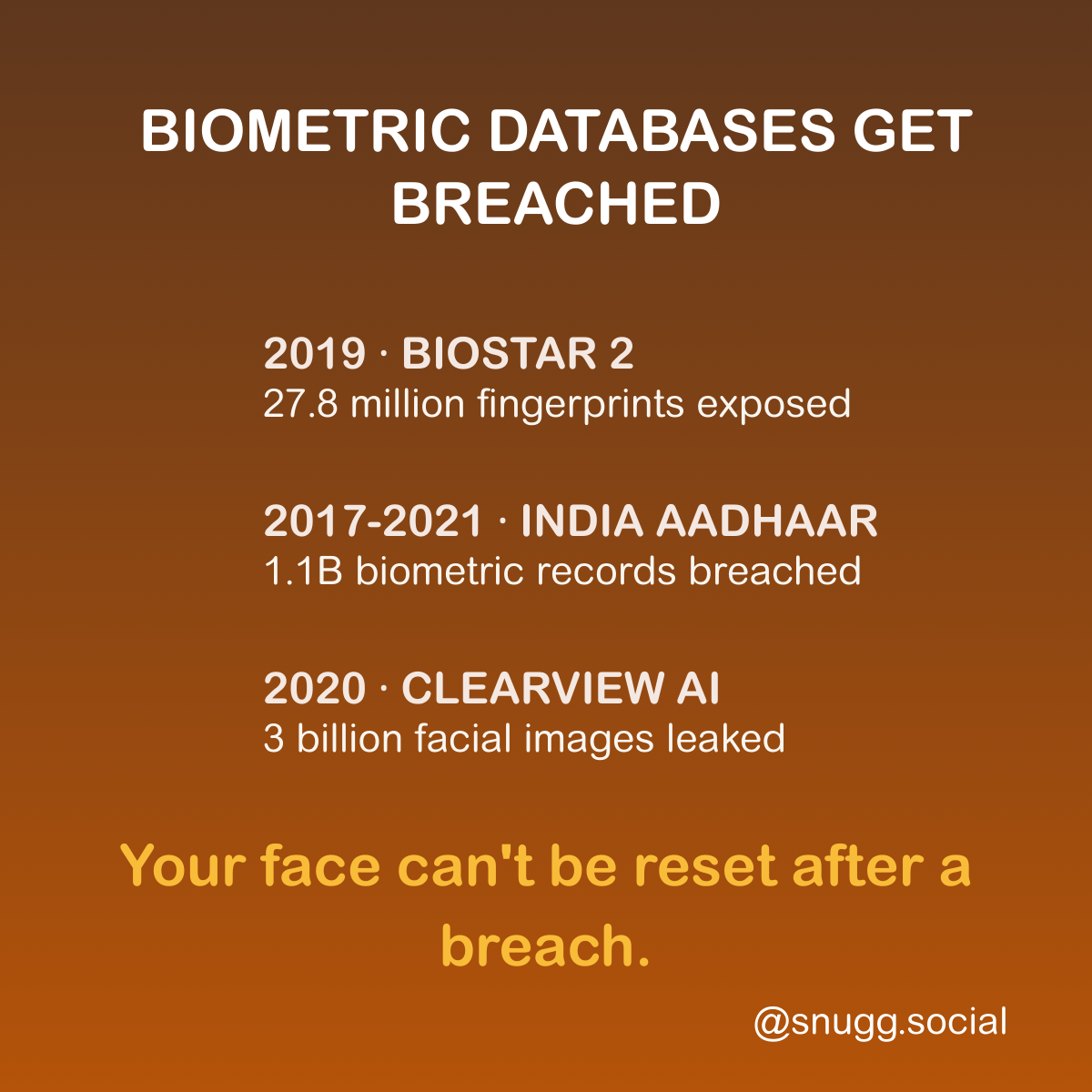

Lass mich dir von BioStar 2 erzählen.

2019 entdeckten Sicherheitsforscher eine unverschlüsselte Datenbank mit 27,8 Millionen Datensätzen. Fingerabdrücke. Gesichtserkennungsdaten. Genutzt von Banken, Polizei, der UK Metropolitan Police, Verteidigungsunternehmen.

Die Fingerabdrücke waren nicht gehasht. Sie wurden als echte Bilder gespeichert. Bilder, die kopiert werden konnten.

Die Passwörter? Im Klartext gespeichert.

Die Forscher fanden heraus, dass sie "die URL-Suchkriterien in Elasticsearch manipulieren" konnten, um auf alles zuzugreifen. Das war's. So ausgeklügelt musste der Angriff sein.

Dann gibt es Clearview AI.

2020 stahlen Hacker ihre gesamte Kundenliste. Das FBI. Das Department of Homeland Security. ICE. Über 600 Strafverfolgungsbehörden.

Clearview hatte 3 Milliarden Gesichtsbilder aus sozialen Medien abgegriffen. Und dann stahl jemand die Liste aller, die diese Datenbank nutzten.

Clearviews Antwort? "Leider sind Datenlecks Teil des Lebens im 21. Jahrhundert."

Senator Ed Markey sagte, was wir alle denken: "Wenn dein Passwort gehackt wird, kannst du dein Passwort ändern. Wenn deine Kreditkartennummer gehackt wird, kannst du deine Karte sperren. Aber du kannst biometrische Informationen wie deine Gesichtsmerkmale nicht ändern, wenn ein Unternehmen wie Clearview diese Daten nicht sicher aufbewahrt."

Indiens Aadhaar-System ist die weltweit größte biometrische Datenbank. 1,1 Milliarden Fingerabdrücke und Iris-Scans. Es wurde mehrfach über mehrere Jahre hinweg gehackt.

Der Global Risks Report 2019 des Weltwirtschaftsforums bezeichnete es als "das größte Datenleck der Welt."

2023 tauchten 815 Millionen Datensätze zum Verkauf in Darknet-Foren auf. Der Preis? 80.000 Dollar.

Das FBI hat 641 Millionen Gesichtsbilder in seiner Gesichtserkennungs-Datenbank. Die meisten wurden für nicht-kriminelle Zwecke gesammelt — Führerscheine, Reisepässe. Das FBI weigert sich, die Genauigkeit seiner eigenen Systeme zu bewerten. Kein Durchsuchungsbefehl für Abfragen erforderlich.

Erkennst du das Muster?

Eine Datenbank wird erstellt "für Sicherheit" oder "zur Verifizierung." Sie wächst. Mission Creep fügt mehr Anwendungsfälle hinzu. Und irgendwann wird sie gehackt.

Die Frage ist nicht OB biometrische Datenbanken gehackt werden. Die Frage ist WANN. Und wie schlimm der Schaden ist, wenn es passiert.

Bei Passwörtern ist der Schaden temporär. Passwort ändern, Problem gelöst.

Bei biometrischen Daten ist der Schaden dauerhaft. Du kannst dein Gesicht nicht ändern.

Was Discord tatsächlich verlangt

Discords Ankündigung klingt auf den ersten Blick vernünftig.

"Zum Schutz von Jugendlichen müssen Nutzer ihr Alter durch Gesichtsschätzung verifizieren."

Lass mich übersetzen, was sie tatsächlich verlangen.

Sie wollen dein Gesicht. Einen unwiderruflichen biometrischen Identifikator. Gescannt von einem Drittunternehmen namens Yoti. Für eine binäre Prüfung — über 18 oder nicht. "Kurz verarbeitet und dann gelöscht", sagen sie.

Was bekommst du im Gegenzug?

Weiterhin Nutzung einer Chat-App.

Was riskierst du?

Biometrische Exposition, wenn etwas schiefgeht. Drittanbieter-Zugang zu deinen Gesichtsdaten — du vertraust nicht nur Discord, du vertraust Yoti. Kein Rechtsmittel bei Missbrauch der Daten, weil du dein Gesicht nicht ändern kannst. Und vielleicht am wichtigsten: du normalisierst die Praxis. Akzeptierst, dass dies ein vernünftiger Tauschhandel ist.

Hier ist der Kontext, der das besonders besorgniserregend macht.

Dies ist dasselbe Unternehmen, dessen Altersverifikations-Anbieter im September 2025 gehackt wurde. Der Breach legte 70.000 Regierungsausweise offen. Fünf Monate später rollen sie globale Gesichtsverifikation aus.

Discord behauptet, "diese Anbieter waren nicht in dieses Datenleck involviert." Aber sie nutzen jetzt mehrere Anbieter. Wir wissen nicht welche. Wir kennen ihre Sicherheitsbilanz nicht.

Du gibst biometrische Identifikatoren ab, um eine Gaming-Chat-App zu nutzen.

Das Risiko-Nutzen-Verhältnis ergibt keinen Sinn.

Warum "anonymisiert" nicht sicher bedeutet

Discords Verteidigung klingt beruhigend.

"Die Gesichtsdaten werden auf dem Gerät verarbeitet und nie gespeichert."

Schauen wir uns an, was das tatsächlich bedeutet.

Dein Gesicht wird gescannt. Gesichtsmerkmale werden extrahiert — Geometrie, Abstände, Muster. Ein Algorithmus schätzt dein Alter. Discord sagt, das Bild wird gelöscht.

Aber hier ist, was sie dir nicht sagen.

Der Prozess extrahiert trotzdem biometrische Merkmale. Auch wenn das Originalbild gelöscht wird, wurden Merkmale extrahiert und verarbeitet. Forschung zeigt, dass Gesichts-Embeddings — mathematische Repräsentationen deines Gesichts — verwendet werden können, um erkennbare Gesichter zu rekonstruieren.

"On-Device-Verarbeitung" ist nicht immer auf dem Gerät. Discord erklärt, dass das Video-Selfie entweder auf deinem Gerät verarbeitet wird ODER "kurz von Yoti verarbeitet und dann gelöscht wird."

Dieses "oder" ist wichtig.

Aktuelle Forschung ist besorgniserregend. Studien demonstrieren, dass "rekonstruierte Gesichter für den Zugang zu anderen realen Gesichtserkennungssystemen verwendet werden können." Eine umfassende Übersicht über inverse Biometrie fand, dass Rekonstruktionstechniken "auf Fingerabdrücke, Iris, Handform, Gesicht und Handschrift angewendet wurden."

Die Annahme, dass "biometrische Vorlagen nicht genug Informationen enthalten, um rückentwickelt zu werden", ist zunehmend veraltet.

Du musst der Implementierung vertrauen. Wie gründlich ist die Löschung? Werden Metadaten mitgespeichert? Was passiert während der Übertragung? Der Code ist proprietär — du kannst ihn nicht prüfen.

Datenlecks passieren in jeder Phase. Es geht nicht nur um die finale Speicherung. Daten können abgefangen werden während der Erfassung. Während der Übertragung. Während der Verarbeitung. Bevor die Löschung abgeschlossen ist.

Ein Bericht von 2024 fand zahlreiche Schwachstellen in biometrischen Systemen, einschließlich einer, bei der Angreifer "auf die biometrische Datenbank der Maschine zugreifen und sie aus der Ferne ändern" und "ihr eigenes Gesicht ins System hochladen" konnten.

Das Präzedenzfall-Problem

"Es ist nur Altersverifikation. Was ist das große Problem?"

Das große Problem ist der Präzedenzfall.

Ich habe dieses Muster schon beobachtet.

Zuerst gibt es eine vernünftige Rechtfertigung. "Wir müssen das Alter verifizieren, um Kinder zu schützen." Wer will dagegen argumentieren?

Dann begrenzter Umfang. "Nur zur Altersverifikation." "Nur mit deiner Zustimmung."

Dann Umfangserweiterung. "Auch zur Identitätsverifikation." "Auch zur Zahlungsverifikation." "Auch für Inhaltszugang."

Dann universelle Anforderung. "Um Vorschriften zu erfüllen..." "Aus Sicherheitsgründen..." "Alle Konten müssen verifizieren..."

Und schließlich normalisierte Überwachung. Gesichtserkennung wird erwartet. Jede Plattform verlangt es. Du kannst nicht teilnehmen, ohne dich zu unterwerfen.

Wir haben dieses Muster mit Telefonnummern gesehen. Begann als "optionale Wiederherstellung." Jetzt für die meisten Plattformen erforderlich.

Wir haben es mit echten Namen gesehen. Begann als Facebook-Experiment. Jetzt eine Standard-Erwartung.

Wir haben es mit Standortzugang gesehen. Begann als "optionales Feature." Jetzt funktionieren viele Apps ohne nicht.

Biometrische Daten sind die letzte Grenze.

Sobald wir Gesichtsscans für "Altersverifikation" normalisieren, haben wir akzeptiert, dass Plattformen unwiderrufliche biometrische Anmeldedaten verlangen können. Dass Dritte unsere Gesichtsdaten verarbeiten können. Dass Bequemlichkeit dauerhafte Sicherheitsrisiken rechtfertigt.

Wenn wir es hier akzeptieren, wird jede Plattform folgen.

Was du tun kannst

Du hast Optionen.

Nicht verifizieren. Behalte deine biometrische Privatsphäre. Kein dauerhaftes Expositionsrisiko. Du sendest ein Marktsignal — niedrige Verifikationsraten bedeuten schlechte Politik. Du verlierst möglicherweise Zugang zu einigen Discord-Funktionen. Aber wenn du es dir leisten kannst, Discord-Zugang zu verlieren, ist dies die sicherste Option.

Mit Gesichtsscan verifizieren. Voller Discord-Zugang bleibt erhalten. Aber dein Gesicht wird von Dritten verarbeitet. Du hast die Praxis normalisiert. Unbekannte langfristige Auswirkungen. Nur in Betracht ziehen, wenn Discord kritische Infrastruktur für dich ist UND du die Risiken verstehst.

Discord verlassen. Vollständiger Datenschutz. Stimme mit den Füßen ab — das stärkste Marktsignal. Du musst Communities migrieren und neue Plattformen lernen. Aber wenn es machbar ist, ist dies die prinzipientreue Wahl.

Alternativen zu Discord

Wenn du überlegst zu gehen, gibt es datenschutzfreundliche Alternativen.

Für Communities und Gruppen empfehle ich Matrix / Element. Ende-zu-Ende verschlüsselte Nachrichten und Sprache/Video. Dezentralisiert — kein einzelnes Unternehmen kontrolliert es. Open Source, also ist der Code prüfbar. Es gibt sogar eine Bridge zu Discord für den Übergang. Keine biometrischen Daten erforderlich. Kostenlos.

Revolt hat eine Discord-ähnliche Oberfläche, wenn du etwas Vertrautes willst. Datenschutzorientiert. Selbst-hostbar. Keine biometrischen Anforderungen. Auch kostenlos.

Für private Nachrichten bleibt Signal der Goldstandard. Ende-zu-Ende verschlüsselt, einschließlich Metadaten. Open Source. Keine biometrischen Daten. Gruppen bis zu 1.000 Personen.

Session ist wie Signal, aber dezentralisiert. Keine Telefonnummer erforderlich. Onion-geroutet für eine extra Datenschutzschicht.

Für soziale Communities bietet Mastodon ein dezentrales soziales Netzwerk. Keine Überwachung. Wähle deinen Server oder betreibe deinen eigenen. Keine biometrischen Daten erforderlich.

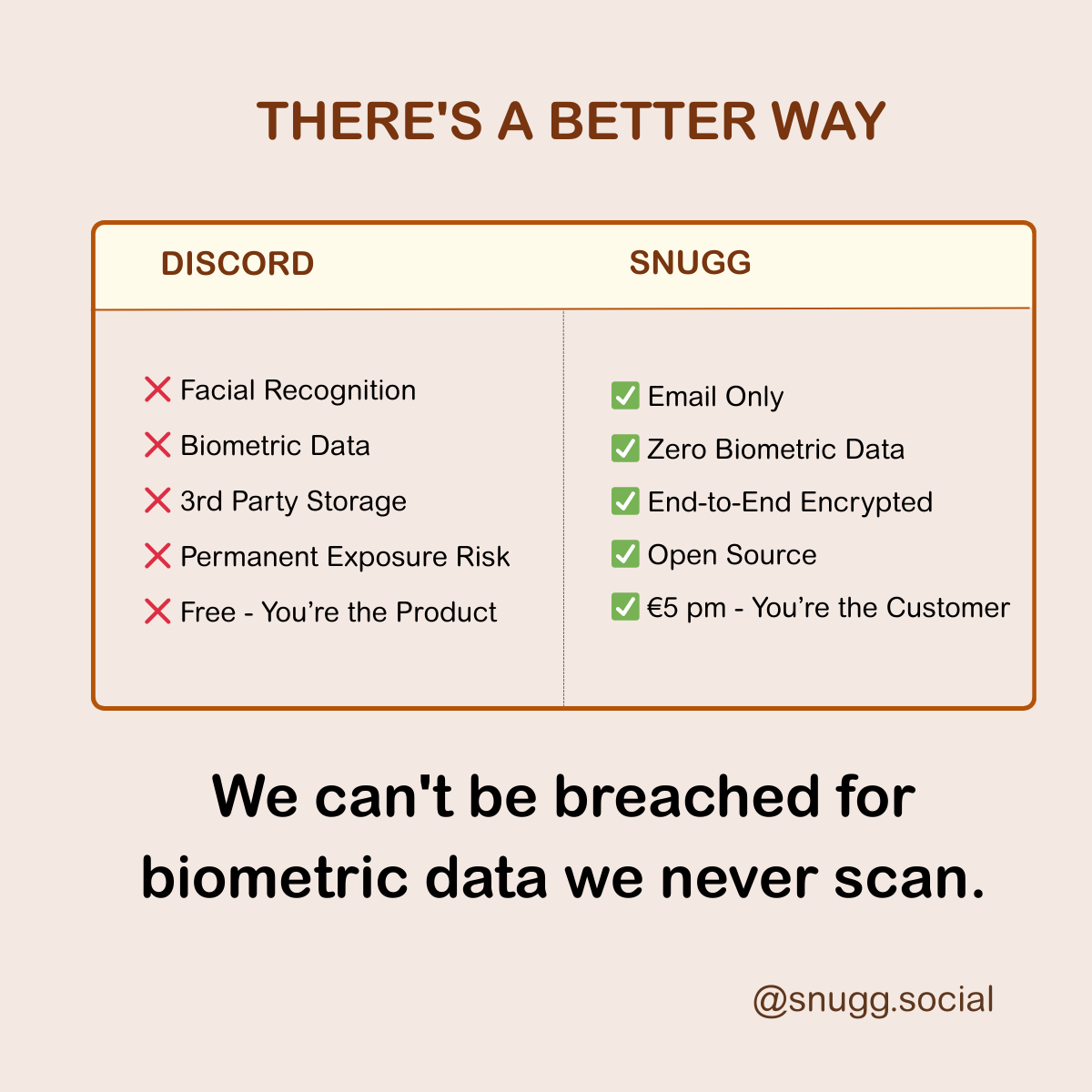

Warum ich Snugg baue

1.000 Menschen haben meine Nachricht über biometrische Daten geteilt.

Das hat mich etwas Wichtiges gelehrt. Menschen wissen, dass Überwachung ein Problem ist. Sie wissen nicht, dass Lösungen existieren.

Also lass mich explizit sagen, was wir bauen.

Snugg wird niemals Gesichtserkennung verwenden. Nicht jetzt, nicht jemals. Keine Fingerabdruck-Scans. Keine Iris-Scans. Keine Stimmabdrücke. Keine biometrischen Daten jeglicher Art.

Was wir verwenden: nur E-Mail — widerrufbar bei Kompromittierung. Optionaler Benutzername — standardmäßig pseudonym. Keine Telefonnummer. Kein echter Name, es sei denn, du entscheidest dich zu teilen.

Warum können wir das?

Geschäftsmodell.

Kostenlose Plattformen brauchen Werbung. Werbung braucht Überwachung für zielgerichtete Anzeigen. Überwachung braucht Identitätsverifikation. Identitätsverifikation führt zu biometrischen Anforderungen.

Snugg kostet 5 Euro pro Monat. Wir dienen Nutzern, nicht Werbetreibenden. Keine Notwendigkeit für Überwachung. Keine Notwendigkeit für unwiderrufliche Identität.

Wir haben ein Geschäftsmodell gewählt, das deine biometrischen Daten nicht benötigt.

Wir werden niemals biometrische Daten sammeln. Nicht zur Verifikation. Nicht für Sicherheit. Nicht für Features. Nicht für Vorschriften. Niemals.

Wir können keine Daten missbrauchen, die wir nicht sammeln. Können keine Gesichter leaken, die wir nie scannen. Können keine Metadaten verkaufen, die wir nie erfassen. Können keine KI mit Daten trainieren, die wir nicht haben.

Du bist der Kunde, nicht das Produkt. Abonnement-Modell bedeutet, wir dienen dir. Keine Werbung bedeutet kein Überwachungsanreiz. Kein Datenverkauf bedeutet, deine Daten bleiben deine.

Open Source bedeutet prüfbar. Code wird öffentlich sein. Du kannst unsere Versprechen verifizieren. Community kann auf Hintertüren prüfen.

Die Warteliste ist jetzt offen mit über 3.000 Mitgliedern. Wir starten im März 2026. Die ersten 500 bekommen einen lebenslangen 40% Rabatt — 3 Euro pro Monat für immer.

Die Entscheidung

Verpflichtende Gesichtserkennung ist nicht nur ein Plattform-Problem.

Es ist ein Präzedenzfall.

Wenn wir akzeptieren, dass Chat-Apps unwiderrufliche biometrische Identifikatoren verlangen können, haben wir akzeptiert, dass alle Plattformen das können.

Dein Passwort wird geleakt — du änderst es. Deine biometrischen Daten werden geleakt — du bist kompromittiert. Für immer.

Der Tauschhandel ergibt keinen Sinn.

Ich baue die Alternative. Social Media, das nie dein Gesicht sehen muss.

Weil wir keine biometrischen Daten leaken können, die wir nie sammeln.

Schließe dich den Gründungsmitgliedern an →

Start: März 2026 | Erste 500: Lebenslanger 40% Rabatt

Weiterführende Lektüre

- Discord will dein Gesicht scannen. Hier ist, warum ich besorgt bin. – Unsere detaillierte Analyse von Discords spezifischer Ankündigung

- Plattformvergleich: Welche Apps schützen wirklich die Privatsphäre

- Kostenlos bedeutet nicht ohne Kosten: Der wahre Preis von Social Media

Quellen & Weiterführende Literatur

Biometrische Datenlecks:

- BioStar 2 Datenbank-Breach - The Register - August 2019

- BioStar 2 exponiert 28 Millionen Datensätze - Avast - August 2019

- Clearview AI gesamte Kundenliste gestohlen - CNN - Februar 2020

- Clearview AI Datenleck - WeLiveSecurity - Februar 2020

- Aadhaar Datenleck-Analyse - Huntress

- Aadhaar Sicherheitsfehler - Privacy International

- Indische Aadhaar IDs im Darknet - Resecurity - Oktober 2023

- FBI Gesichtserkennung: GAO Report - Juni 2019

- FBI kann 400 Millionen Gesichtserkennungsfotos durchsuchen - EFF - Juni 2016

Biometrische Hash-Schwachstellen:

- Gesichtsrekonstruktion aus Gesichts-Embeddings - arXiv - 2026

- Gesichtsrekonstruktion mit Adapter-Modellen - arXiv - November 2024

- Das Unumkehrbare umkehren: Überblick über inverse Biometrie - arXiv - Januar 2024

Discord Altersverifikation:

- Discord Teen-by-Default Einstellungen Ankündigung - Februar 2026

- Discord Age Assurance FAQ - Discord Support

- Wie man Age Assurance auf Discord abschließt - Discord Support

- Discord Datenleck: 5CA Vendor Hack - Bitdefender - Oktober 2025

Grosse Datenlecks (Kontext):

- Equifax Datenleck-Vergleich - FTC - 147,9 Millionen Datensätze

- 2017 Equifax Datenleck - Wikipedia

- Yahoo 3 Milliarden Konten Breach - BreachSense

Über den Autor

Ich bin Yachtgutachter in der Karibik und der Gründer von Snugg. Nach 15 Jahren, in denen ich beobachtet habe, wie Social-Media-Plattformen Gewinne über Datenschutz stellen, habe ich beschlossen, die Alternative zu bauen. Ich bin kein Datenschutzaktivist — nur jemand, der denkt, dass man nicht sein Gesicht scannen lassen sollte, um mit Freunden zu chatten.

Verbinden: Twitter/X | LinkedIn | E-Mail

Über Snugg: Ich baue die Social-Media-Plattform, die ich mir wünsche. Keine Werbung. Kein Tracking. Keine Algorithmen. Keine Überwachung. Nur du, deine Freunde und echte Kontrolle über dein digitales Leben. Mehr erfahren

Wenn das bei dir Resonanz gefunden hat, teile es bitte. Je mehr Menschen verstehen, was passiert, desto schwerer ist es zu normalisieren.