No puedes cambiar tu cara: Por qué los datos biometricos son un riesgo de seguridad permanente

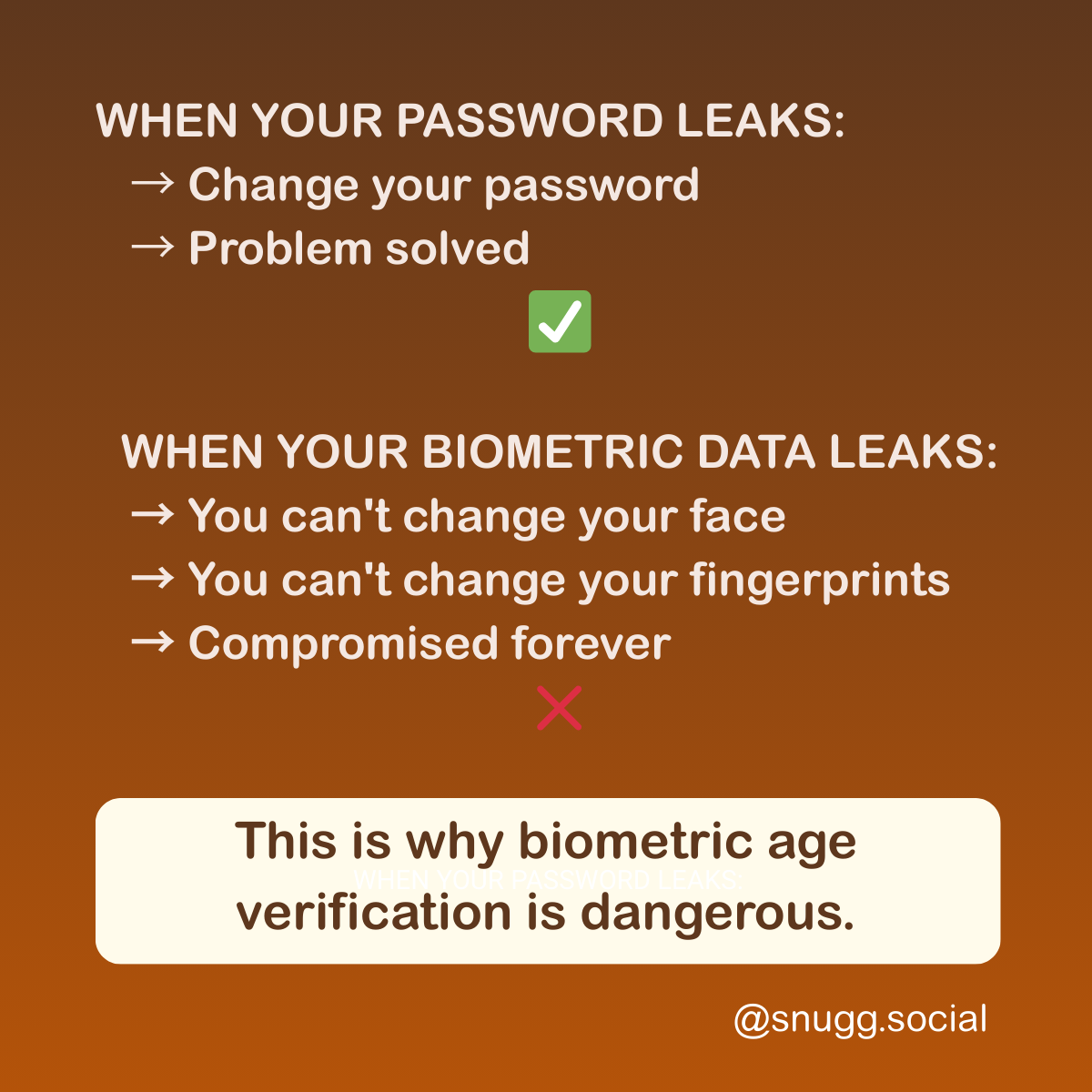

Cuando tu contrasena se filtra, la cambias. Cuando tus datos biometricos se filtran, estas comprometido para siempre.

Publique algo en redes sociales la semana pasada.

Un mensaje simple sobre datos biometricos. Sobre lo que pasa cuando las contrasenas se filtran versus lo que pasa cuando tu cara se filtra.

Mas de 1,000 personas lo compartieron.

Eso no es normal para mis publicaciones. Pero esta toco algo.

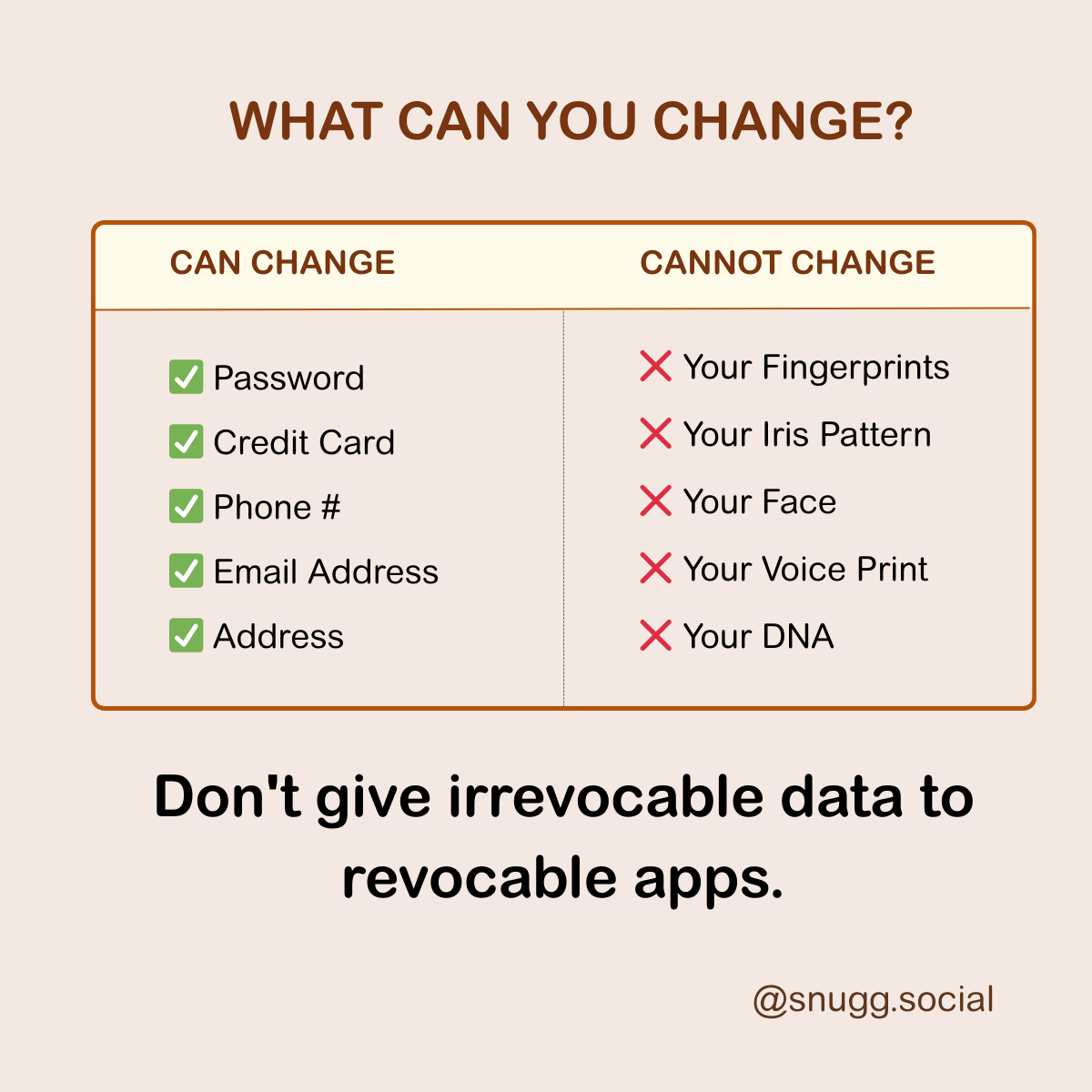

Cuando tu contrasena se filtra:

→ Cambia tu contrasena

>→ Problema resuelto

Cuando tus datos biometricos se filtran:

→ No puedes cambiar tu cara

→ No puedes cambiar tus huellas dactilares

→ El compromiso es permanente

→ Para siempre en bases de datos de filtraciones

Resono porque es verdad.

Pero compartir un problema no es suficiente. Necesitamos entender con que estamos tratando realmente aqui.

Lo que pasa con las caras

Piensa en cada credencial que usas en linea.

¿Tu contrasena se filtra? Molesto, pero la cambias. Problema resuelto.

¿Tu tarjeta de credito es robada? La cancelas, obtienes una nueva. Listo.

¿Tu email es comprometido? Creas una nueva direccion. Sigues adelante.

¿Tu numero de telefono es expuesto? Obtén un nuevo numero. Solucionado.

Incluso tu direccion de casa—si realmente se convierte en un problema, puedes mudarte.

¿Pero tu cara?

Tu cara es la unica credencial que no puedes cambiar, rotar o revocar.

Eres tu. Para siempre.

Cuando una base de datos de contrasenas es hackeada, todos cambian sus contrasenas. Cuando una base de datos biometrica es hackeada, todos mantienen la misma cara.

Exposicion permanente.

Por esto el reconocimiento facial obligatorio para verificacion de edad no es solo una preocupacion de privacidad. Es una catastrofe de seguridad esperando suceder.

"Pero las bases de datos biometricas son mas seguras"

¿Lo son?

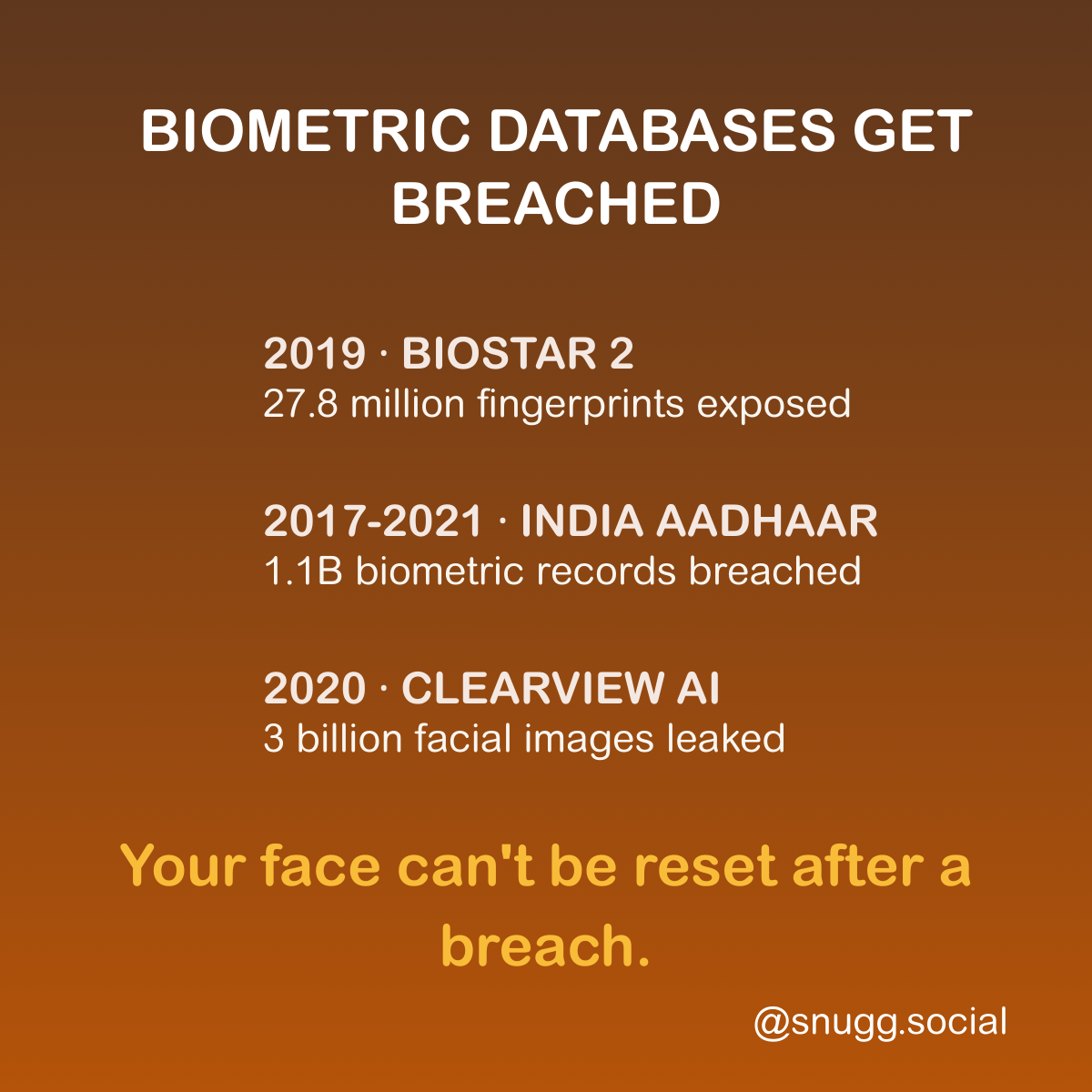

Dejame contarte sobre BioStar 2.

En 2019, investigadores de seguridad descubrieron una base de datos sin cifrar que contenia 27.8 millones de registros. Huellas dactilares. Datos de reconocimiento facial. Usada por bancos, policia, la Policia Metropolitana del Reino Unido, contratistas de defensa.

Las huellas dactilares no estaban hasheadas. Estaban almacenadas como imagenes reales. Imagenes que podian ser copiadas.

¿Las contrasenas? Almacenadas en texto plano.

Los investigadores encontraron que podian "manipular los criterios de busqueda de URL en Elasticsearch" para acceder a todo. Eso es. Asi de sofisticado necesitaba ser el ataque.

Luego esta Clearview AI.

En 2020, hackers robaron su lista completa de clientes. El FBI. Departamento de Seguridad Nacional. ICE. Mas de 600 agencias de aplicacion de la ley.

Clearview habia extraido 3 mil millones de imagenes faciales de redes sociales. Y luego alguien robo la lista de todos los que estaban usando esa base de datos.

¿La respuesta de Clearview? "Desafortunadamente, las filtraciones de datos son parte de la vida en el siglo XXI."

El Senador Ed Markey dijo lo que todos estamos pensando: "Si tu contrasena se filtra, puedes cambiar tu contrasena. Si tu numero de tarjeta de credito se filtra, puedes cancelar tu tarjeta. Pero no puedes cambiar informacion biometrica como tus caracteristicas faciales si una empresa como Clearview no mantiene esos datos seguros."

El sistema Aadhaar de India es la base de datos biometrica mas grande del mundo. 1.1 mil millones de huellas dactilares y escaneos de iris. Ha sido hackeada multiples veces durante varios anos.

El Informe de Riesgos Globales 2019 del Foro Economico Mundial lo llamo "la mayor filtracion de datos del mundo."

En 2023, 815 millones de registros aparecieron a la venta en foros de la dark web. ¿El precio? $80,000.

El FBI tiene 641 millones de imagenes faciales en su base de datos de reconocimiento facial. La mayoria fueron recopiladas para propositos no criminales—licencias de conducir, pasaportes. El FBI se niega a evaluar la precision de sus propios sistemas. No se requiere orden judicial para las busquedas.

¿Ves el patron?

Se crea una base de datos "para seguridad" o "para verificacion." Crece. La expansion de mision anade mas casos de uso. Y eventualmente, es hackeada.

La pregunta no es SI las bases de datos biometricas son hackeadas. La pregunta es CUANDO. Y que tan grave es el dano cuando sucede.

Con contrasenas, el dano es temporal. Cambias tu contrasena, problema resuelto.

Con datos biometricos, el dano es permanente. No puedes cambiar tu cara.

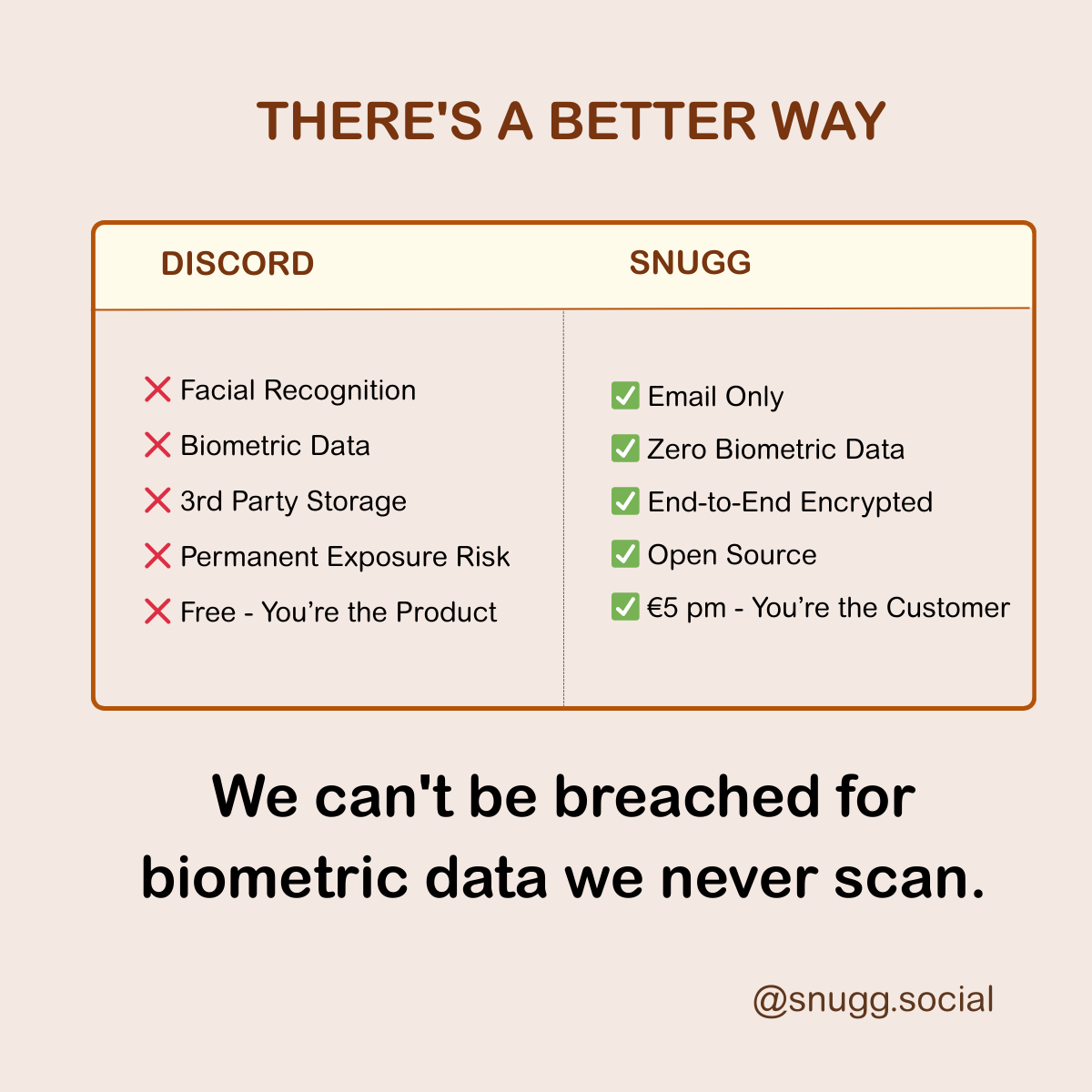

Lo que Discord realmente esta pidiendo

El anuncio de Discord suena razonable en la superficie.

"Para proteger a los adolescentes, los usuarios deben verificar su edad usando estimacion facial."

Dejame traducir lo que realmente estan pidiendo.

Quieren tu cara. Un identificador biometrico irrevocable. Escaneada por una empresa tercera llamada Yoti. Para una verificacion binaria—mayor de 18 o no. "Procesada brevemente y luego eliminada," dicen.

¿Que obtienes a cambio?

Uso continuado de una aplicacion de chat.

¿Que arriesgas?

Exposicion biometrica si algo sale mal. Acceso de terceros a tus datos faciales—no solo confias en Discord, confias en Yoti. Sin recurso si los datos son mal manejados, porque no puedes cambiar tu cara. Y quizas lo mas importante: estas normalizando la practica. Aceptando que este es un intercambio razonable.

Aqui esta el contexto que hace esto particularmente preocupante.

Esta es la misma empresa cuyo proveedor de verificacion de edad fue hackeado en septiembre de 2025. La filtracion expuso 70,000 IDs gubernamentales. Cinco meses despues, estan implementando verificacion facial global.

Discord afirma que "estos proveedores no estuvieron involucrados" en esa filtracion. Pero ahora usan multiples proveedores. No sabemos cuales. No conocemos su historial de seguridad.

Estas proporcionando identificadores biometricos para usar una aplicacion de chat de juegos.

La relacion riesgo/beneficio no tiene sentido.

Por que "anonimizado" no significa seguro

La defensa de Discord suena tranquilizadora.

"Los datos faciales se procesan en el dispositivo y nunca se almacenan."

Examinemos lo que eso realmente significa.

Tu cara es escaneada. Las caracteristicas faciales son extraidas—geometria, distancias, patrones. Un algoritmo estima tu edad. Discord dice que la imagen es eliminada.

Pero esto es lo que no te estan diciendo.

El proceso aun extrae caracteristicas biometricas. Incluso si la imagen original es eliminada, las caracteristicas fueron extraidas y procesadas. La investigacion demuestra que los embeddings faciales—representaciones matematicas de tu cara—pueden usarse para reconstruir caras reconocibles.

"Procesamiento en el dispositivo" no siempre es en el dispositivo. Discord declara que el video selfie es procesado en tu dispositivo O "procesado brevemente por Yoti y luego eliminado."

Ese "o" importa.

La investigacion reciente es preocupante. Los estudios demuestran que "las caras reconstruidas pueden usarse para acceder a otros sistemas de reconocimiento facial del mundo real." Una revision exhaustiva sobre biometria inversa encontro que las tecnicas de reconstruccion han sido "aplicadas a huellas dactilares, iris, forma de mano, cara y escritura a mano."

La suposicion de que "las plantillas biometricas no contienen suficiente informacion para ser revertidas" esta cada vez mas desactualizada.

Tienes que confiar en la implementacion. ¿Que tan fuerte es la eliminacion? ¿Se almacenan metadatos junto con los datos? ¿Que pasa durante la transmision? El codigo es propietario—no puedes auditarlo.

Las filtraciones ocurren en cada etapa. No se trata solo del almacenamiento final. Los datos pueden ser interceptados durante la captura. Durante la transmision. Durante el procesamiento. Antes de que la eliminacion se complete.

Un informe de 2024 encontro docenas de vulnerabilidades en sistemas biometricos, incluyendo una donde los atacantes podian "acceder y alterar remotamente la base de datos biometrica de la maquina" y "subir su propia cara al sistema."

El problema del precedente

"Es solo verificacion de edad. ¿Cual es el problema?"

El problema es el precedente.

He observado este patron antes.

Primero, hay una justificacion razonable. "Necesitamos verificar la edad para proteger a los ninos." ¿Quien va a discutir con eso?

Luego, alcance limitado. "Solo para verificacion de edad." "Solo con tu consentimiento."

Luego, expansion del alcance. "Tambien para verificacion de identidad." "Tambien para verificacion de pago." "Tambien para acceso a contenido."

Luego, requisito universal. "Para cumplir con regulaciones..." "Por razones de seguridad..." "Todas las cuentas deben verificar..."

Y finalmente, vigilancia normalizada. El reconocimiento facial es esperado. Toda plataforma lo requiere. No puedes participar sin someterte.

Hemos visto este patron con los numeros de telefono. Comenzo como "recuperacion opcional." Ahora es requerido para la mayoria de plataformas.

Lo hemos visto con los nombres reales. Comenzo como un experimento de Facebook. Ahora es una expectativa estandar.

Lo hemos visto con el acceso a ubicacion. Comenzo como una "funcion opcional." Ahora muchas apps no funcionan sin el.

Los datos biometricos son la ultima frontera.

Una vez que normalicemos los escaneos faciales para "verificacion de edad," hemos aceptado que las plataformas pueden requerir credenciales biometricas irrevocables. Que terceros pueden procesar nuestros datos faciales. Que la conveniencia justifica riesgos de seguridad permanentes.

Si lo aceptamos aqui, toda plataforma seguira.

Que puedes hacer

Tienes opciones.

No verificar. Mantén tu privacidad biometrica. Sin riesgo de exposicion permanente. Envias una senal de mercado—bajas tasas de verificacion significan mala politica. Puedes perder acceso a algunas funciones de Discord. Pero si puedes permitirte perder acceso a Discord, esta es la opcion mas segura.

Verificar con escaneo facial. Acceso completo a Discord mantenido. Pero tu cara es procesada por terceros. Has normalizado la practica. Implicaciones a largo plazo desconocidas. Solo considera esto si Discord es infraestructura critica para ti Y entiendes los riesgos.

Dejar Discord. Proteccion completa de privacidad. Vota con tus pies—la senal de mercado mas poderosa. Necesitas migrar comunidades y aprender nuevas plataformas. Pero si es viable, esta es la eleccion de principios.

Alternativas a Discord

Si estas considerando irte, existen alternativas que respetan la privacidad.

Para comunidades y grupos, recomiendo Matrix / Element. Mensajes y voz/video cifrados de extremo a extremo. Descentralizado—ninguna empresa lo controla. Codigo abierto, asi que el codigo es auditable. Incluso hay un puente a Discord para la transicion. No se requieren datos biometricos. Gratis.

Revolt tiene una interfaz similar a Discord si quieres algo familiar. Enfocado en privacidad. Auto-hospedable. Sin requisitos biometricos. Tambien gratis.

Para mensajeria privada, Signal sigue siendo el estandar de oro. Cifrado de extremo a extremo incluyendo metadatos. Codigo abierto. Sin datos biometricos. Grupos de hasta 1,000 personas.

Session es como Signal pero descentralizado. No se requiere numero de telefono. Enrutado por Onion para una capa extra de privacidad.

Para comunidades sociales, Mastodon ofrece una red social descentralizada. Sin vigilancia. Elige tu servidor o ejecuta el tuyo propio. No se requieren datos biometricos.

Por que estoy construyendo Snugg

1,000 personas compartieron mi mensaje sobre datos biometricos.

Eso me enseno algo importante. La gente sabe que la vigilancia es un problema. No saben que existen soluciones.

Asi que dejame ser explicito sobre lo que estamos construyendo.

Snugg nunca usara reconocimiento facial. Ni ahora, ni nunca. Sin escaneos de huellas dactilares. Sin escaneos de iris. Sin huellas de voz. Sin datos biometricos de ningun tipo.

Lo que si usamos: solo email—revocable si es comprometido. Nombre de usuario opcional—pseudonimo por defecto. Sin numero de telefono. Sin nombre real a menos que elijas compartirlo.

¿Por que podemos hacer esto?

Modelo de negocio.

Las plataformas gratuitas necesitan publicidad. La publicidad necesita vigilancia para segmentar anuncios. La vigilancia necesita verificacion de identidad. La verificacion de identidad lleva a requisitos biometricos.

Snugg cuesta €5 por mes. Servimos a usuarios, no a anunciantes. No hay necesidad de vigilancia. No hay necesidad de identidad irrevocable.

Elegimos un modelo de negocio que no requiere tus datos biometricos.

Nunca recopilaremos datos biometricos. No para verificacion. No para seguridad. No para funciones. No para regulaciones. Nunca.

No podemos abusar de datos que no recopilamos. No podemos filtrar caras que nunca escaneamos. No podemos vender metadatos que nunca capturamos. No podemos entrenar IA con datos que no tenemos.

Eres el cliente, no el producto. El modelo de suscripcion significa que te servimos a ti. Sin publicidad significa sin incentivo de vigilancia. Sin venta de datos significa que tus datos siguen siendo tuyos.

Codigo abierto significa auditable. El codigo sera publico. Puedes verificar nuestras promesas. La comunidad puede inspeccionar en busca de puertas traseras.

La lista de espera esta abierta ahora con mas de 3,000 miembros. Lanzamos en marzo de 2026. Los primeros 500 obtienen un descuento del 40% de por vida—€3 por mes para siempre.

La eleccion

El reconocimiento facial obligatorio no es solo un problema de plataforma.

Es un precedente.

Si aceptamos que las aplicaciones de chat pueden requerir identificadores biometricos irrevocables, hemos aceptado que todas las plataformas pueden.

Tu contrasena se filtra—la cambias. Tus datos biometricos se filtran—estas comprometido. Para siempre.

El intercambio no tiene sentido.

Estoy construyendo la alternativa. Redes sociales que nunca necesitan ver tu cara.

Porque no podemos filtrar datos biometricos que nunca recopilamos.

Unete a los miembros fundadores →

Lanzamiento: Marzo 2026 | Primeros 500: Descuento del 40% de por vida

Lectura relacionada

- Discord quiere escanear tu cara. Aqui esta por que estoy preocupado. – Nuestro analisis detallado del anuncio especifico de Discord

- Comparacion de plataformas: Que aplicaciones realmente protegen la privacidad

- Gratis no significa sin costo: El verdadero precio de las redes sociales

Fuentes y lecturas adicionales

Filtraciones de datos biometricos:

- Filtracion de base de datos BioStar 2 - The Register - Agosto 2019

- BioStar 2 expone 28 millones de registros - Avast - Agosto 2019

- Lista completa de clientes de Clearview AI robada - CNN - Febrero 2020

- Filtracion de datos de Clearview AI - WeLiveSecurity - Febrero 2020

- Analisis de filtracion de datos Aadhaar - Huntress

- Fallos de seguridad de Aadhaar - Privacy International

- IDs Aadhaar indios en Dark Web - Resecurity - Octubre 2023

- Reconocimiento facial del FBI: Informe GAO - Junio 2019

- El FBI puede buscar 400 millones de fotos de reconocimiento facial - EFF - Junio 2016

Vulnerabilidades de hash biometrico:

- Reconstruccion facial a partir de embeddings faciales - arXiv - 2026

- Reconstruccion facial usando modelos adaptadores - arXiv - Noviembre 2024

- Revirtiendo lo irreversible: Revision sobre biometria inversa - arXiv - Enero 2024

Verificacion de edad de Discord:

- Anuncio de configuracion Teen-by-Default de Discord - Febrero 2026

- FAQ de Age Assurance de Discord - Soporte de Discord

- Como completar Age Assurance en Discord - Soporte de Discord

- Filtracion de datos de Discord: Hackeo del proveedor 5CA - Bitdefender - Octubre 2025

Grandes filtraciones de datos (Contexto):

- Acuerdo de filtracion de datos Equifax - FTC - 147.9 millones de registros

- Filtracion de datos Equifax 2017 - Wikipedia

- Filtracion de 3 mil millones de cuentas de Yahoo - BreachSense

Sobre el autor

Soy inspector de yates en el Caribe y fundador de Snugg. Despues de 15 anos viendo como las plataformas de redes sociales priorizan las ganancias sobre la privacidad, decidi construir la alternativa. No soy un activista de la privacidad—solo alguien que piensa que no deberias necesitar escanear tu cara para chatear con amigos.

Conectar: Twitter/X | LinkedIn | Email

Sobre Snugg: Estoy construyendo la plataforma de redes sociales que desearia que existiera. Sin anuncios. Sin rastreo. Sin algoritmos. Sin vigilancia. Solo tu, tus amigos y control real sobre tu vida digital. Saber mas

Si esto resono contigo, por favor compartelo. Cuantas mas personas entiendan lo que esta pasando, mas dificil sera normalizarlo.