Vous ne pouvez pas changer votre visage : Pourquoi les données biométriques sont un risque de sécurité permanent

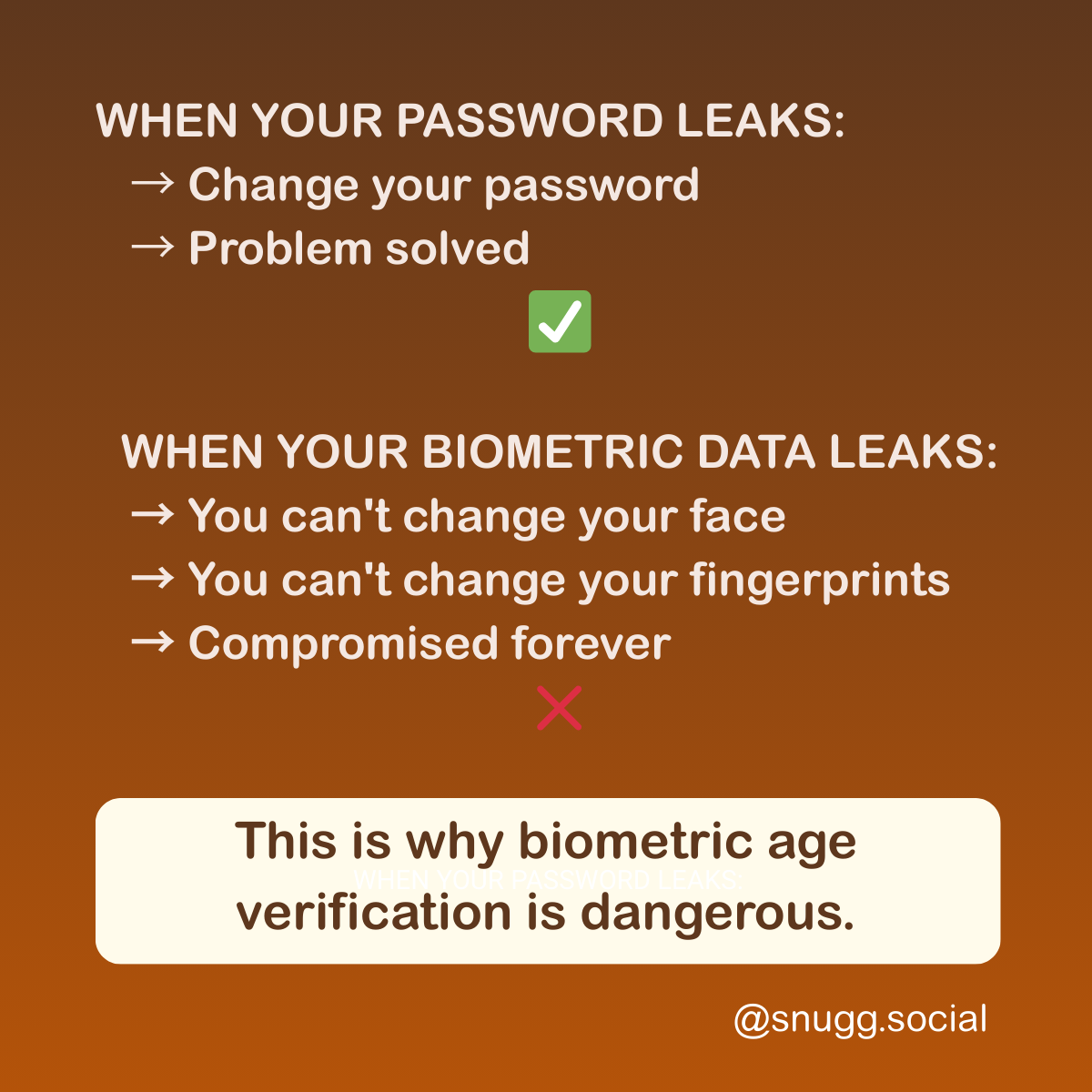

Quand votre mot de passe fuit, vous le changez. Quand vos données biométriques fuitent, vous êtes compromis pour toujours.

J'ai publié quelque chose sur les réseaux sociaux la semaine dernière.

Un simple message sur les données biométriques. Sur ce qui se passe quand les mots de passe fuitent versus ce qui se passe quand votre visage fuite.

Plus de 1 000 personnes l'ont partagé.

Ce n'est pas normal pour mes publications. Mais celle-ci a touché quelque chose.

Quand votre mot de passe fuit :

→ Changez votre mot de passe

>→ Problème résolu

Quand vos données biométriques fuitent :

→ Vous ne pouvez pas changer votre visage

→ Vous ne pouvez pas changer vos empreintes digitales

→ La compromission est permanente

→ Pour toujours dans les bases de données de fuites

Ça a résonné parce que c'est vrai.

Mais partager un problème ne suffit pas. Nous devons comprendre ce à quoi nous avons réellement affaire ici.

Le truc avec les visages

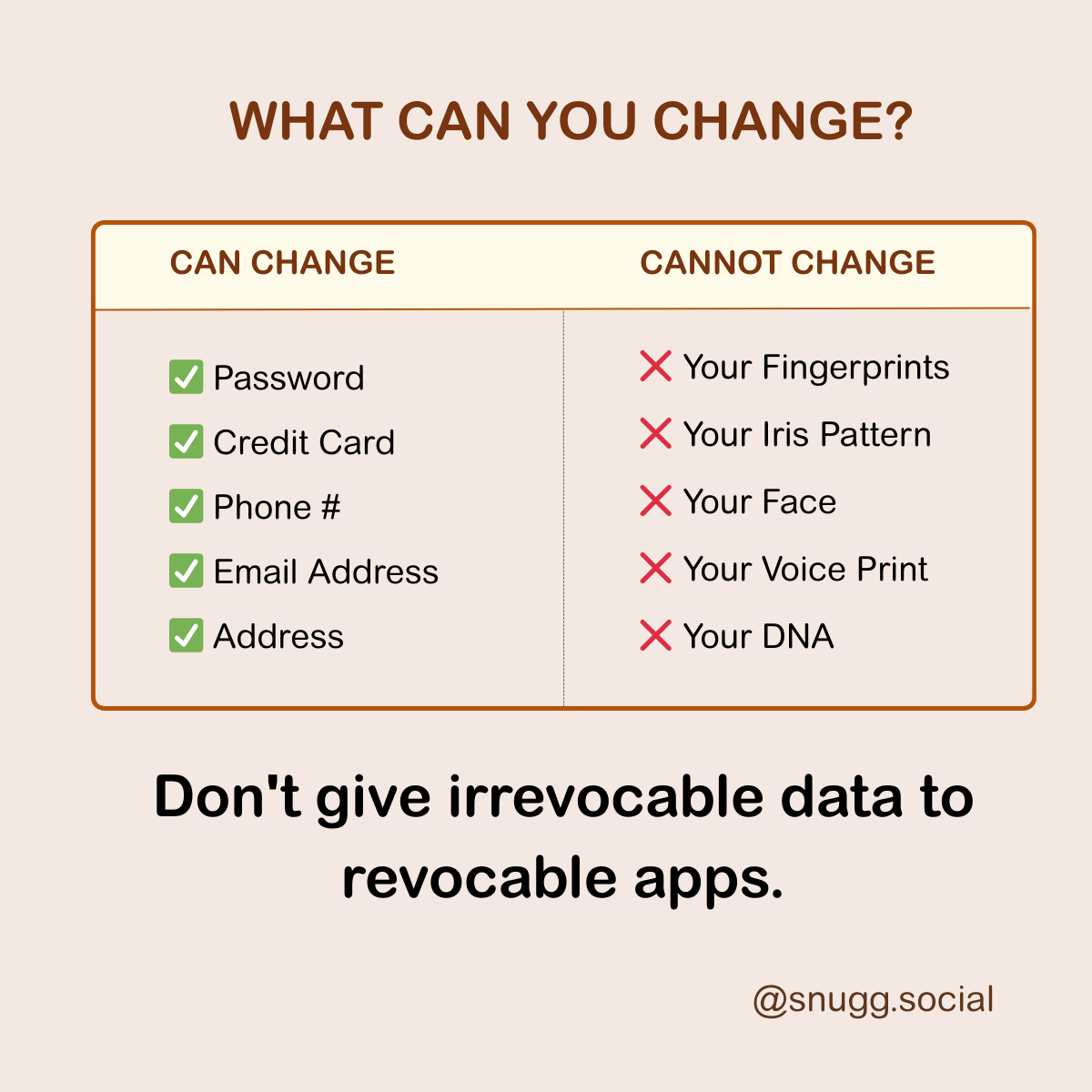

Pensez à chaque identifiant que vous utilisez en ligne.

Votre mot de passe est fuité ? Énervant, mais vous le changez. Problème résolu.

Votre carte de crédit est volée ? Vous l'annulez, vous en obtenez une nouvelle. Terminé.

Votre email est compromis ? Vous créez une nouvelle adresse. Passez à autre chose.

Votre numéro de téléphone est exposé ? Obtenez un nouveau numéro. Réglé.

Même votre adresse postale—si ça devient vraiment un problème, vous pouvez déménager.

Mais votre visage ?

Votre visage est le seul identifiant que vous ne pouvez pas changer, faire tourner ou révoquer.

C'est vous. Pour toujours.

Quand une base de données de mots de passe est piratée, tout le monde change ses mots de passe. Quand une base de données biométrique est piratée, tout le monde garde le même visage.

Exposition permanente.

C'est pourquoi la reconnaissance faciale obligatoire pour la vérification d'âge n'est pas juste une préoccupation de vie privée. C'est une catastrophe sécuritaire en devenir.

"Mais les bases de données biométriques sont plus sécurisées"

Vraiment ?

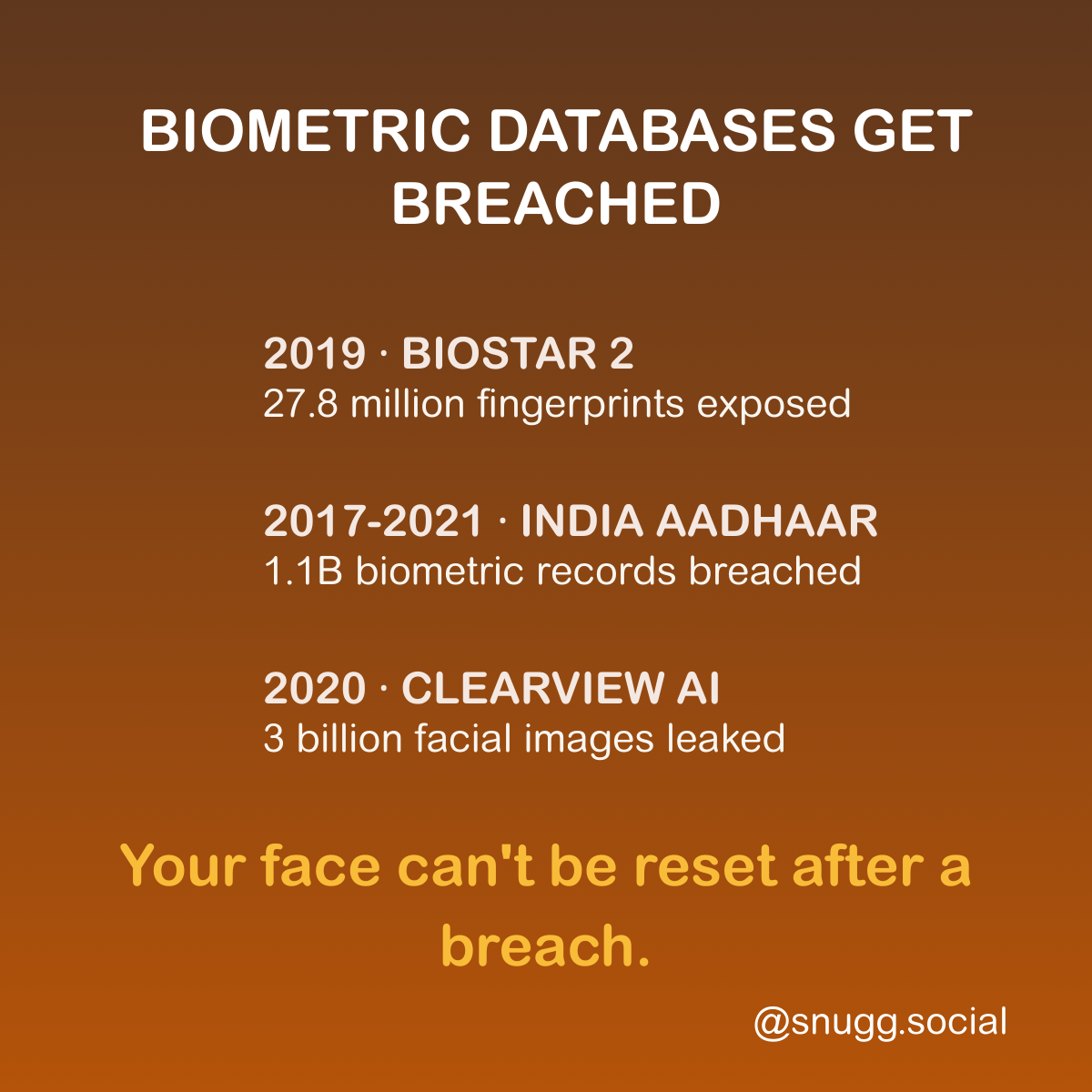

Laissez-moi vous parler de BioStar 2.

En 2019, des chercheurs en sécurité ont découvert une base de données non chiffrée contenant 27,8 millions d'enregistrements. Empreintes digitales. Données de reconnaissance faciale. Utilisées par des banques, la police, la Police métropolitaine du Royaume-Uni, des contractants de défense.

Les empreintes digitales n'étaient pas hachées. Elles étaient stockées comme images réelles. Des images qui pouvaient être copiées.

Les mots de passe ? Stockés en clair.

Les chercheurs ont découvert qu'ils pouvaient « manipuler les critères de recherche d'URL dans Elasticsearch » pour tout accéder. C'est tout. C'est à quel point l'attaque devait être sophistiquée.

Ensuite, il y a Clearview AI.

En 2020, des hackers ont volé leur liste complète de clients. Le FBI. Le Département de la Sécurité intérieure. ICE. Plus de 600 agences d'application de la loi.

Clearview avait extrait 3 milliards d'images faciales des réseaux sociaux. Et puis quelqu'un a volé la liste de tous ceux qui utilisaient cette base de données.

La réponse de Clearview ? « Malheureusement, les fuites de données font partie de la vie au 21e siècle. »

Le Sénateur Ed Markey a dit ce que nous pensions tous : « Si votre mot de passe est piraté, vous pouvez changer votre mot de passe. Si votre numéro de carte de crédit est piraté, vous pouvez annuler votre carte. Mais vous ne pouvez pas changer des informations biométriques comme vos caractéristiques faciales si une entreprise comme Clearview ne sécurise pas ces données. »

Le système Aadhaar de l'Inde est la plus grande base de données biométrique au monde. 1,1 milliard d'empreintes digitales et scans d'iris. Elle a été piratée plusieurs fois sur plusieurs années.

Le Rapport sur les risques mondiaux 2019 du Forum économique mondial l'a qualifiée de « plus grande fuite de données au monde ».

En 2023, 815 millions d'enregistrements sont apparus à la vente sur des forums du dark web. Le prix demandé ? 80 000 $.

Le FBI possède 641 millions d'images faciales dans sa base de données de reconnaissance faciale. La plupart ont été collectées pour des raisons non criminelles—permis de conduire, passeports. Le FBI refuse d'évaluer la précision de ses propres systèmes. Aucun mandat requis pour les recherches.

Vous voyez le schéma ?

Une base de données est créée « pour la sécurité » ou « pour la vérification ». Elle grandit. La dérive de mission ajoute plus de cas d'utilisation. Et finalement, elle est piratée.

La question n'est pas SI les bases de données biométriques sont piratées. La question est QUAND. Et quelle est la gravité des dommages quand ça arrive.

Avec les mots de passe, les dommages sont temporaires. Changez votre mot de passe, problème résolu.

Avec les données biométriques, les dommages sont permanents. Vous ne pouvez pas changer votre visage.

Ce que Discord demande réellement

L'annonce de Discord semble raisonnable en surface.

« Pour protéger les adolescents, les utilisateurs doivent vérifier leur âge en utilisant l'estimation faciale. »

Laissez-moi traduire ce qu'ils demandent réellement.

Ils veulent votre visage. Un identifiant biométrique irrévocable. Scanné par une entreprise tierce appelée Yoti. Pour une vérification binaire—plus de 18 ans ou non. « Traité brièvement puis supprimé », disent-ils.

Qu'obtenez-vous en retour ?

L'utilisation continue d'une application de chat.

Que risquez-vous ?

Une exposition biométrique si quelque chose tourne mal. Un accès tiers à vos données faciales—vous ne faites pas seulement confiance à Discord, vous faites confiance à Yoti. Aucun recours si les données sont mal gérées, parce que vous ne pouvez pas changer votre visage. Et peut-être le plus important : vous normalisez la pratique. Vous acceptez que c'est un compromis raisonnable.

Voici le contexte qui rend cela particulièrement préoccupant.

C'est la même entreprise dont le fournisseur de vérification d'âge a été piraté en septembre 2025. La fuite a exposé 70 000 pièces d'identité gouvernementales. Cinq mois plus tard, ils déploient la vérification faciale mondiale.

Discord affirme que « ces fournisseurs n'étaient pas impliqués » dans cette fuite. Mais ils utilisent maintenant plusieurs fournisseurs. Nous ne savons pas lesquels. Nous ne connaissons pas leur historique de sécurité.

Vous fournissez des identifiants biométriques pour utiliser une application de chat de jeux.

Le rapport risque/bénéfice n'a pas de sens.

Pourquoi « anonymisé » ne signifie pas sûr

La défense de Discord semble rassurante.

« Les données faciales sont traitées sur l'appareil et jamais stockées. »

Examinons ce que cela signifie réellement.

Votre visage est scanné. Les caractéristiques faciales sont extraites—géométrie, distances, motifs. Un algorithme estime votre âge. Discord dit que l'image est supprimée.

Mais voici ce qu'ils ne vous disent pas.

Le processus extrait toujours des caractéristiques biométriques. Même si l'image originale est supprimée, les caractéristiques ont été extraites et traitées. La recherche démontre que les embeddings faciaux—représentations mathématiques de votre visage—peuvent être utilisés pour reconstruire des visages reconnaissables.

« Traitement sur l'appareil » n'est pas toujours sur l'appareil. Discord déclare que le selfie vidéo est soit traité sur votre appareil SOIT « traité brièvement par Yoti puis supprimé ».

Ce « soit » compte.

La recherche récente est préoccupante. Des études démontrent que « les visages reconstruits peuvent être utilisés pour accéder à d'autres systèmes de reconnaissance faciale du monde réel ». Une revue complète sur la biométrie inverse a trouvé que les techniques de reconstruction ont été « appliquées aux empreintes digitales, iris, forme de la main, visage et écriture manuscrite ».

L'hypothèse que « les modèles biométriques ne contiennent pas assez d'informations pour être rétro-ingéniérés » est de plus en plus obsolète.

Vous devez faire confiance à l'implémentation. Quelle est la force de la suppression ? Les métadonnées sont-elles stockées en parallèle ? Que se passe-t-il pendant la transmission ? Le code est propriétaire—vous ne pouvez pas l'auditer.

Les fuites se produisent à chaque étape. Il ne s'agit pas seulement du stockage final. Les données peuvent être interceptées pendant la capture. Pendant la transmission. Pendant le traitement. Avant que la suppression ne soit terminée.

Un rapport de 2024 a trouvé des dizaines de vulnérabilités dans les systèmes biométriques, y compris une où les attaquants pouvaient « accéder et modifier à distance la base de données biométrique de la machine » et « télécharger leur propre visage dans le système ».

Le problème du précédent

« C'est juste la vérification d'âge. Quel est le problème ? »

Le problème, c'est le précédent.

J'ai déjà observé ce schéma.

D'abord, il y a une justification raisonnable. « Nous devons vérifier l'âge pour protéger les enfants. » Qui va contester ça ?

Ensuite, une portée limitée. « Seulement pour la vérification d'âge. » « Seulement avec votre consentement. »

Puis, l'expansion de la portée. « Aussi pour la vérification d'identité. » « Aussi pour la vérification de paiement. » « Aussi pour l'accès au contenu. »

Puis, l'exigence universelle. « Pour se conformer aux réglementations... » « Pour des raisons de sécurité... » « Tous les comptes doivent vérifier... »

Et finalement, la surveillance normalisée. La reconnaissance faciale est attendue. Chaque plateforme l'exige. Vous ne pouvez pas participer sans vous soumettre.

Nous avons vu ce schéma avec les numéros de téléphone. Ça a commencé comme « récupération optionnelle ». Maintenant requis pour la plupart des plateformes.

Nous l'avons vu avec les vrais noms. Ça a commencé comme une expérience Facebook. Maintenant une attente standard.

Nous l'avons vu avec l'accès à la localisation. Ça a commencé comme une « fonctionnalité optionnelle ». Maintenant beaucoup d'applications ne fonctionnent pas sans.

Les données biométriques sont la dernière frontière.

Une fois que nous normalisons les scans faciaux pour « la vérification d'âge », nous avons accepté que les plateformes peuvent exiger des identifiants biométriques irrévocables. Que des tiers peuvent traiter nos données faciales. Que la commodité justifie des risques de sécurité permanents.

Si nous l'acceptons ici, chaque plateforme suivra.

Ce que vous pouvez faire

Vous avez des options.

Ne pas vérifier. Gardez votre vie privée biométrique. Pas de risque d'exposition permanente. Vous envoyez un signal de marché—des taux de vérification faibles signifient une mauvaise politique. Vous pourriez perdre l'accès à certaines fonctionnalités Discord. Mais si vous pouvez vous permettre de perdre l'accès à Discord, c'est l'option la plus sûre.

Vérifier avec scan facial. Accès complet à Discord maintenu. Mais votre visage est traité par des tiers. Vous avez normalisé la pratique. Implications à long terme inconnues. N'envisagez cela que si Discord est une infrastructure critique pour vous ET que vous comprenez les risques.

Quitter Discord. Protection complète de la vie privée. Votez avec vos pieds—le signal de marché le plus puissant. Vous devez migrer les communautés et apprendre de nouvelles plateformes. Mais si c'est viable, c'est le choix de principe.

Alternatives à Discord

Si vous envisagez de partir, des alternatives respectueuses de la vie privée existent.

Pour les communautés et groupes, je recommanderais Matrix / Element. Messages et voix/vidéo chiffrés de bout en bout. Décentralisé—aucune entreprise ne le contrôle. Open source, donc le code est auditable. Il y a même une passerelle vers Discord pour la transition. Aucune donnée biométrique requise. Gratuit.

Revolt a une interface similaire à Discord si vous voulez quelque chose de familier. Axé sur la vie privée. Auto-hébergeable. Pas d'exigences biométriques. Également gratuit.

Pour la messagerie privée, Signal reste la référence. Chiffré de bout en bout, y compris les métadonnées. Open source. Pas de données biométriques. Groupes jusqu'à 1 000 personnes.

Session est comme Signal mais décentralisé. Pas de numéro de téléphone requis. Routé par Onion pour une couche de vie privée supplémentaire.

Pour les communautés sociales, Mastodon offre un réseau social décentralisé. Pas de surveillance. Choisissez votre serveur ou exécutez le vôtre. Aucune donnée biométrique requise.

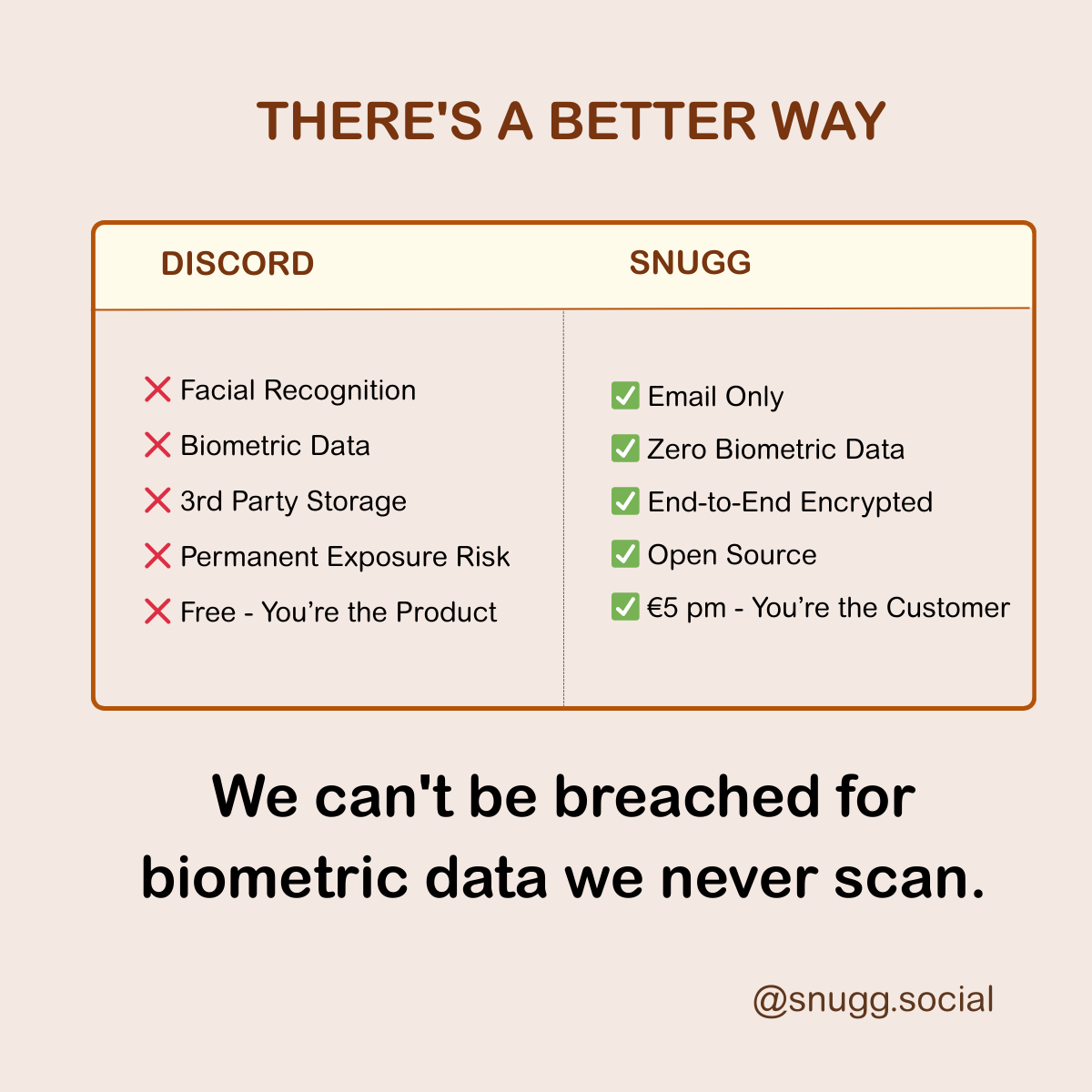

Pourquoi je construis Snugg

1 000 personnes ont partagé mon message sur les données biométriques.

Ça m'a appris quelque chose d'important. Les gens savent que la surveillance est un problème. Ils ne savent pas que des solutions existent.

Alors laissez-moi être explicite sur ce que nous construisons.

Snugg n'utilisera jamais la reconnaissance faciale. Ni maintenant, ni jamais. Pas de scans d'empreintes digitales. Pas de scans d'iris. Pas d'empreintes vocales. Aucune donnée biométrique d'aucune sorte.

Ce que nous utilisons : email uniquement—révocable si compromis. Nom d'utilisateur optionnel—pseudonyme par défaut. Pas de numéro de téléphone. Pas de vrai nom sauf si vous choisissez de le partager.

Pourquoi pouvons-nous faire cela ?

Modèle économique.

Les plateformes gratuites ont besoin de publicité. La publicité a besoin de surveillance pour cibler les annonces. La surveillance a besoin de vérification d'identité. La vérification d'identité mène aux exigences biométriques.

Snugg coûte 5 € par mois. Nous servons les utilisateurs, pas les annonceurs. Pas besoin de surveillance. Pas besoin d'identité irrévocable.

Nous avons choisi un modèle économique qui ne nécessite pas vos données biométriques.

Nous ne collecterons jamais de données biométriques. Pas pour la vérification. Pas pour la sécurité. Pas pour les fonctionnalités. Pas pour les réglementations. Jamais.

Nous ne pouvons pas abuser des données que nous ne collectons pas. Ne pouvons pas fuiter des visages que nous ne scannons jamais. Ne pouvons pas vendre des métadonnées que nous ne capturons jamais. Ne pouvons pas entraîner l'IA sur des données que nous n'avons pas.

Vous êtes le client, pas le produit. Le modèle d'abonnement signifie que nous vous servons. Pas de publicité signifie pas d'incitation à la surveillance. Pas de vente de données signifie que vos données restent les vôtres.

Open source signifie auditable. Le code sera public. Vous pouvez vérifier nos promesses. La communauté peut inspecter les portes dérobées.

La liste d'attente est ouverte maintenant avec plus de 3 000 membres. Nous lançons en mars 2026. Les 500 premiers obtiennent une réduction à vie de 40 %—3 € par mois pour toujours.

Rejoindre la liste d'attente →

Le choix

La reconnaissance faciale obligatoire n'est pas juste un problème de plateforme.

C'est un précédent.

Si nous acceptons que les applications de chat peuvent exiger des identifiants biométriques irrévocables, nous avons accepté que toutes les plateformes le peuvent.

Votre mot de passe fuite—vous le changez. Vos données biométriques fuitent—vous êtes compromis. Pour toujours.

Le compromis n'a pas de sens.

Je construis l'alternative. Des réseaux sociaux qui n'ont jamais besoin de voir votre visage.

Parce que nous ne pouvons pas fuiter des données biométriques que nous ne collectons jamais.

Rejoignez les membres fondateurs →

Lancement : Mars 2026 | 500 premiers : Réduction à vie de 40 %

Lectures connexes

- Discord veut scanner votre visage. Voici pourquoi je suis inquiet. – Notre analyse détaillée de l'annonce spécifique de Discord

- Comparaison des plateformes : Quelles applications protègent vraiment la vie privée

- Gratuit ne signifie pas sans coût : Le vrai prix des réseaux sociaux

Sources et lectures complémentaires

Fuites de données biométriques :

- Fuite de base de données BioStar 2 - The Register - Août 2019

- BioStar 2 expose 28 millions d'enregistrements - Avast - Août 2019

- Liste complète des clients Clearview AI volée - CNN - Février 2020

- Fuite de données Clearview AI - WeLiveSecurity - Février 2020

- Analyse de la fuite de données Aadhaar - Huntress

- Échecs de sécurité Aadhaar - Privacy International

- IDs Aadhaar indiens sur le Dark Web - Resecurity - Octobre 2023

- Reconnaissance faciale FBI : Rapport GAO - Juin 2019

- Le FBI peut rechercher 400 millions de photos de reconnaissance faciale - EFF - Juin 2016

Vulnérabilités des hachages biométriques :

- Reconstruction faciale à partir d'embeddings faciaux - arXiv - 2026

- Reconstruction faciale utilisant des modèles adaptateurs - arXiv - Novembre 2024

- Inverser l'irréversible : Revue sur la biométrie inverse - arXiv - Janvier 2024

Vérification d'âge Discord :

- Annonce des paramètres Teen-by-Default de Discord - Février 2026

- FAQ Age Assurance Discord - Support Discord

- Comment compléter Age Assurance sur Discord - Support Discord

- Fuite de données Discord : Piratage du fournisseur 5CA - Bitdefender - Octobre 2025

Grandes fuites de données (Contexte) :

- Règlement de fuite de données Equifax - FTC - 147,9 millions d'enregistrements

- Fuite de données Equifax 2017 - Wikipedia

- Fuite de 3 milliards de comptes Yahoo - BreachSense

À propos de l'auteur

Je suis expert maritime dans les Caraïbes et le fondateur de Snugg. Après 15 ans à regarder les plateformes de réseaux sociaux prioriser les profits sur la vie privée, j'ai décidé de construire l'alternative. Je ne suis pas un activiste de la vie privée—juste quelqu'un qui pense que vous ne devriez pas avoir besoin de scanner votre visage pour discuter avec des amis.

Connecter : Twitter/X | LinkedIn | Email

À propos de Snugg : Je construis la plateforme de réseaux sociaux que je souhaiterais qui existe. Pas de publicités. Pas de pistage. Pas d'algorithmes. Pas de surveillance. Juste vous, vos amis, et un vrai contrôle sur votre vie numérique. En savoir plus

Si cela a résonné avec vous, partagez-le s'il vous plaît. Plus les gens comprennent ce qui se passe, plus il est difficile de le normaliser.