Você Não Pode Mudar Seu Rosto: Por Que Dados Biométricos São Um Risco de Segurança Permanente

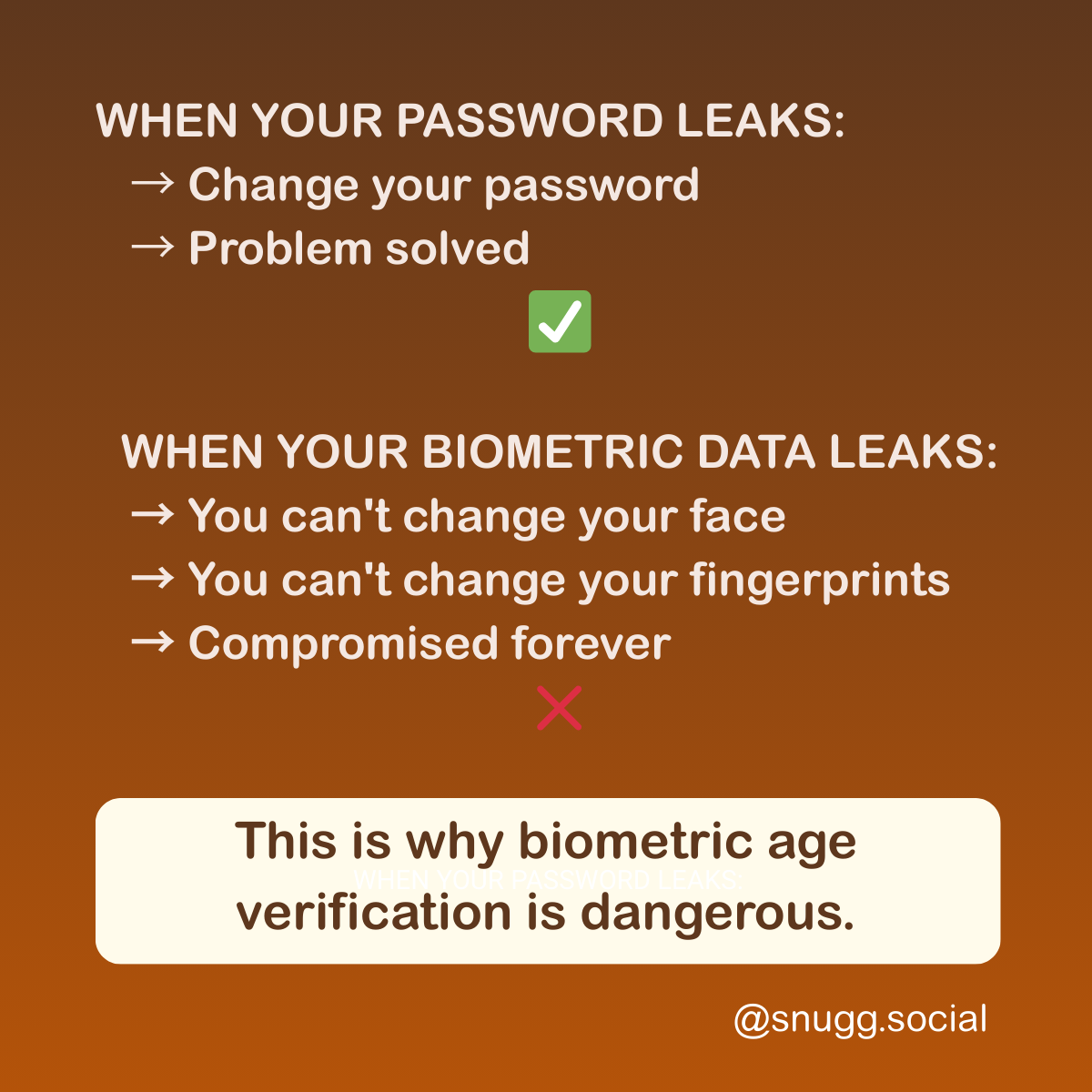

Quando sua senha vaza, você a muda. Quando seus dados biométricos vazam, você está comprometido para sempre.

Eu publiquei algo nas redes sociais semana passada.

Uma mensagem simples sobre dados biométricos. Sobre o que acontece quando senhas vazam versus o que acontece quando seu rosto vaza.

Mais de 1.000 pessoas compartilharam.

Isso não é normal para as minhas publicações. Mas essa tocou em algo.

Quando sua senha vaza:

→ Mude sua senha

>→ Problema resolvido

Quando seus dados biométricos vazam:

→ Você não pode mudar seu rosto

→ Você não pode mudar suas impressões digitais

→ O comprometimento é permanente

→ Para sempre em bases de dados de vazamentos

Ressoou porque é verdade.

Mas compartilhar um problema não é suficiente. Precisamos entender com o que realmente estamos lidando aqui.

A questão sobre rostos

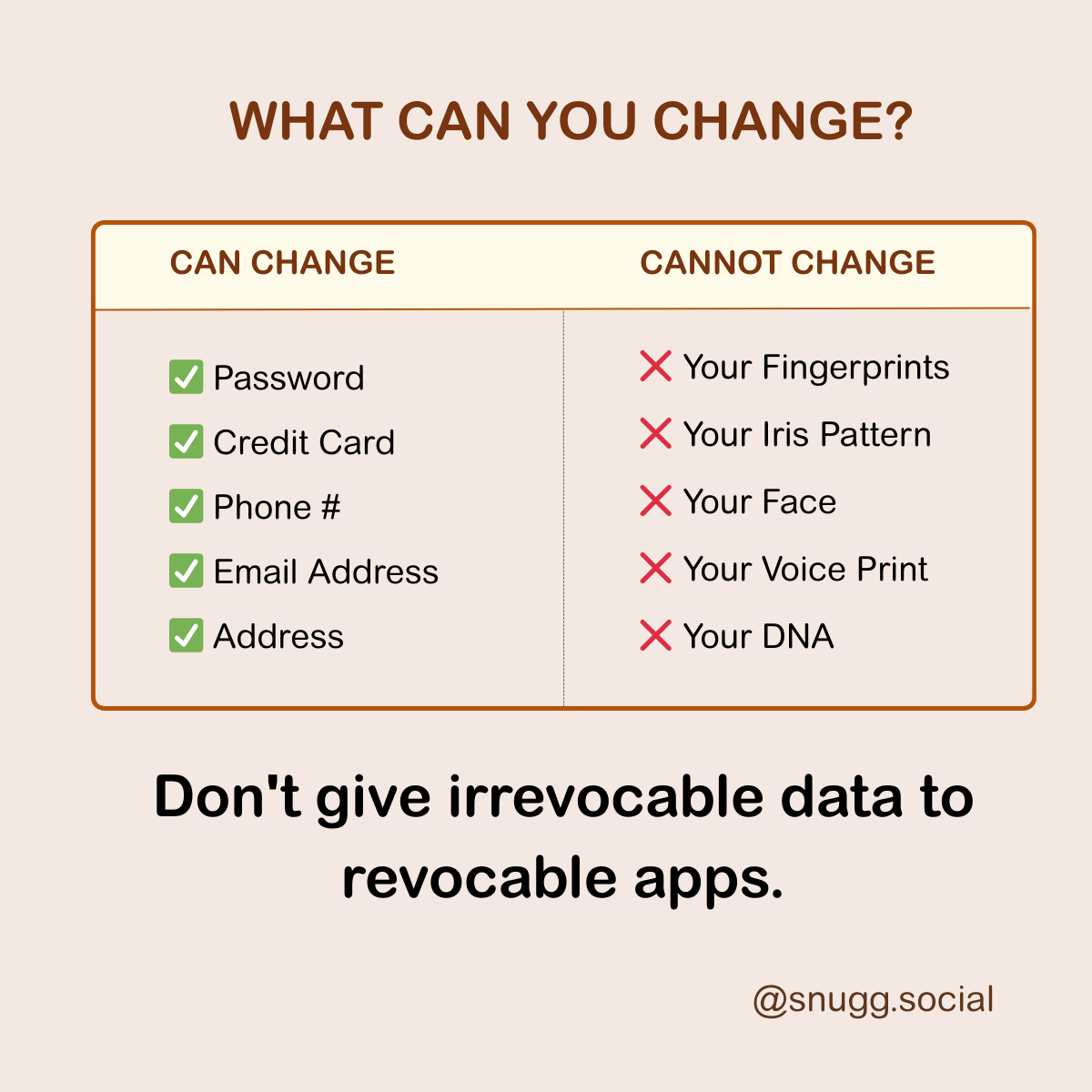

Pense em todas as credenciais que você usa online.

Sua senha vaza? Irritante, mas você a muda. Problema resolvido.

Seu cartão de crédito é roubado? Você cancela, pega um novo. Feito.

Seu e-mail é comprometido? Você cria um novo endereço. Segue em frente.

Seu número de telefone é exposto? Pega um número novo. Resolvido.

Até seu endereço residencial—se realmente se tornar um problema, você pode se mudar.

Mas seu rosto?

Seu rosto é a única credencial que você não pode mudar, rotacionar ou revogar.

É você. Para sempre.

Quando uma base de dados de senhas é violada, todo mundo muda suas senhas. Quando uma base de dados biométrica é violada, todo mundo mantém o mesmo rosto.

Exposição permanente.

É por isso que o reconhecimento facial obrigatório para verificação de idade não é apenas uma preocupação de privacidade. É uma catástrofe de segurança esperando acontecer.

"Mas bases de dados biométricas são mais seguras"

São mesmo?

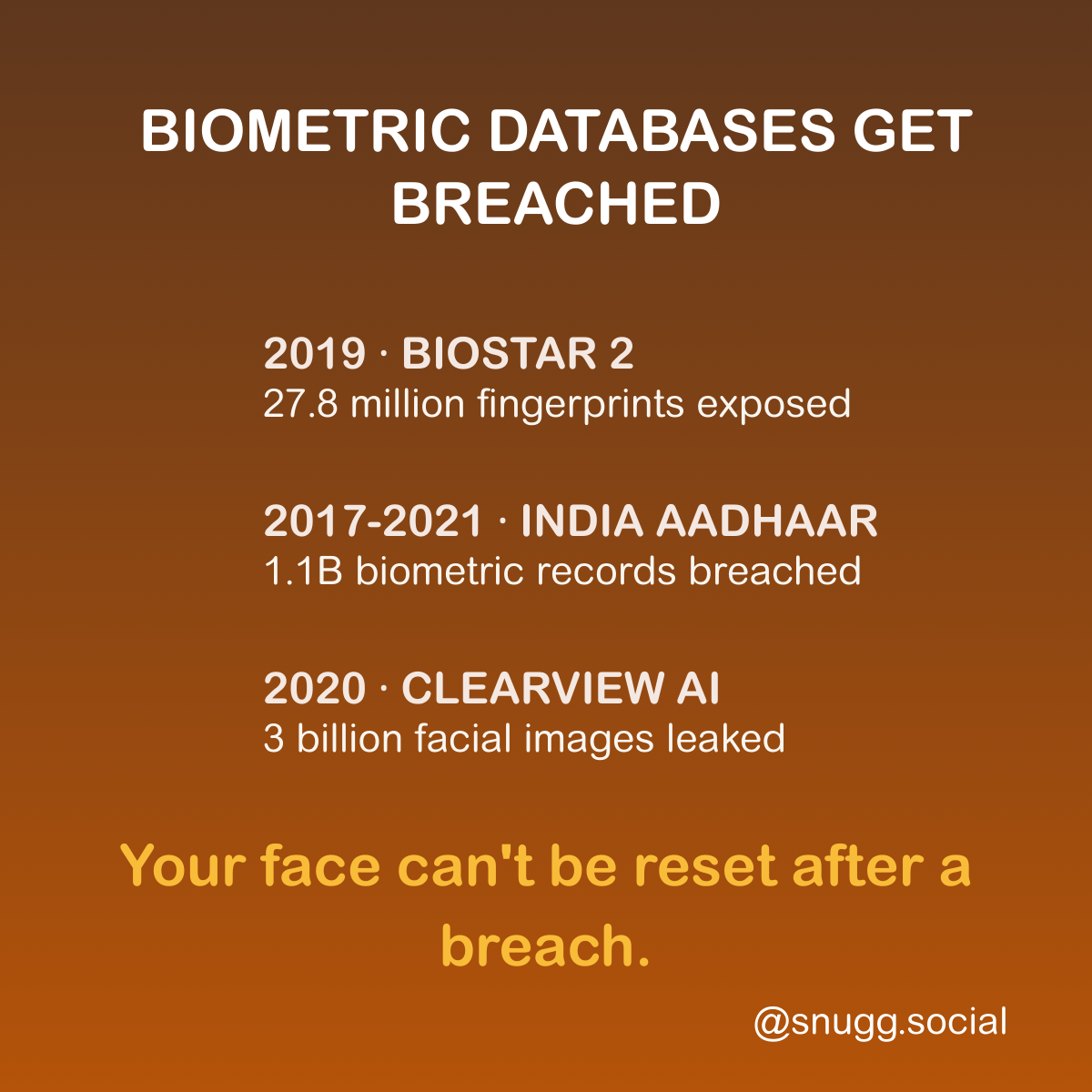

Deixa eu te contar sobre a BioStar 2.

Em 2019, pesquisadores de segurança descobriram uma base de dados não criptografada contendo 27,8 milhões de registros. Impressões digitais. Dados de reconhecimento facial. Usados por bancos, polícia, a Polícia Metropolitana do Reino Unido, contratantes de defesa.

As impressões digitais não estavam hasheadas. Eram armazenadas como imagens reais. Imagens que podiam ser copiadas.

As senhas? Armazenadas em texto puro.

Os pesquisadores descobriram que podiam "manipular os critérios de pesquisa de URL no Elasticsearch" para acessar tudo. Só isso. Era só isso que o ataque precisava ser.

E tem a Clearview AI.

Em 2020, hackers roubaram toda a lista de clientes deles. O FBI. Departamento de Segurança Interna. ICE. Mais de 600 agências de aplicação da lei.

A Clearview tinha coletado 3 bilhões de imagens faciais das redes sociais. E então alguém roubou a lista de todos que estavam usando essa base de dados.

Resposta da Clearview? "Infelizmente, vazamentos de dados fazem parte da vida no século 21."

O Senador Ed Markey disse o que todos estamos pensando: "Se sua senha é violada, você pode mudar sua senha. Se o número do seu cartão de crédito é violado, você pode cancelar seu cartão. Mas você não pode mudar informações biométricas como suas características faciais se uma empresa como a Clearview não consegue manter esses dados seguros."

O sistema Aadhaar da Índia é a maior base de dados biométrica do mundo. 1,1 bilhão de impressões digitais e escaneamentos de íris. Foi violada múltiplas vezes ao longo de vários anos.

O Relatório de Riscos Globais 2019 do Fórum Econômico Mundial o chamou de "o maior vazamento de dados do mundo."

Em 2023, 815 milhões de registros apareceram à venda em fóruns da dark web. O preço pedido? $80.000.

O FBI tem 641 milhões de imagens faciais em sua base de dados de reconhecimento facial. A maioria foi coletada para propósitos não criminais—carteiras de motorista, passaportes. O FBI se recusa a avaliar a precisão de seus próprios sistemas. Nenhum mandado necessário para buscas.

Você vê o padrão?

Uma base de dados é criada "para segurança" ou "para verificação." Ela cresce. A expansão de missão adiciona mais casos de uso. E eventualmente, ela é violada.

A questão não é SE bases de dados biométricas são violadas. A questão é QUANDO. E quão grave é o dano quando acontece.

Com senhas, o dano é temporário. Muda a senha, problema resolvido.

Com dados biométricos, o dano é permanente. Você não pode mudar seu rosto.

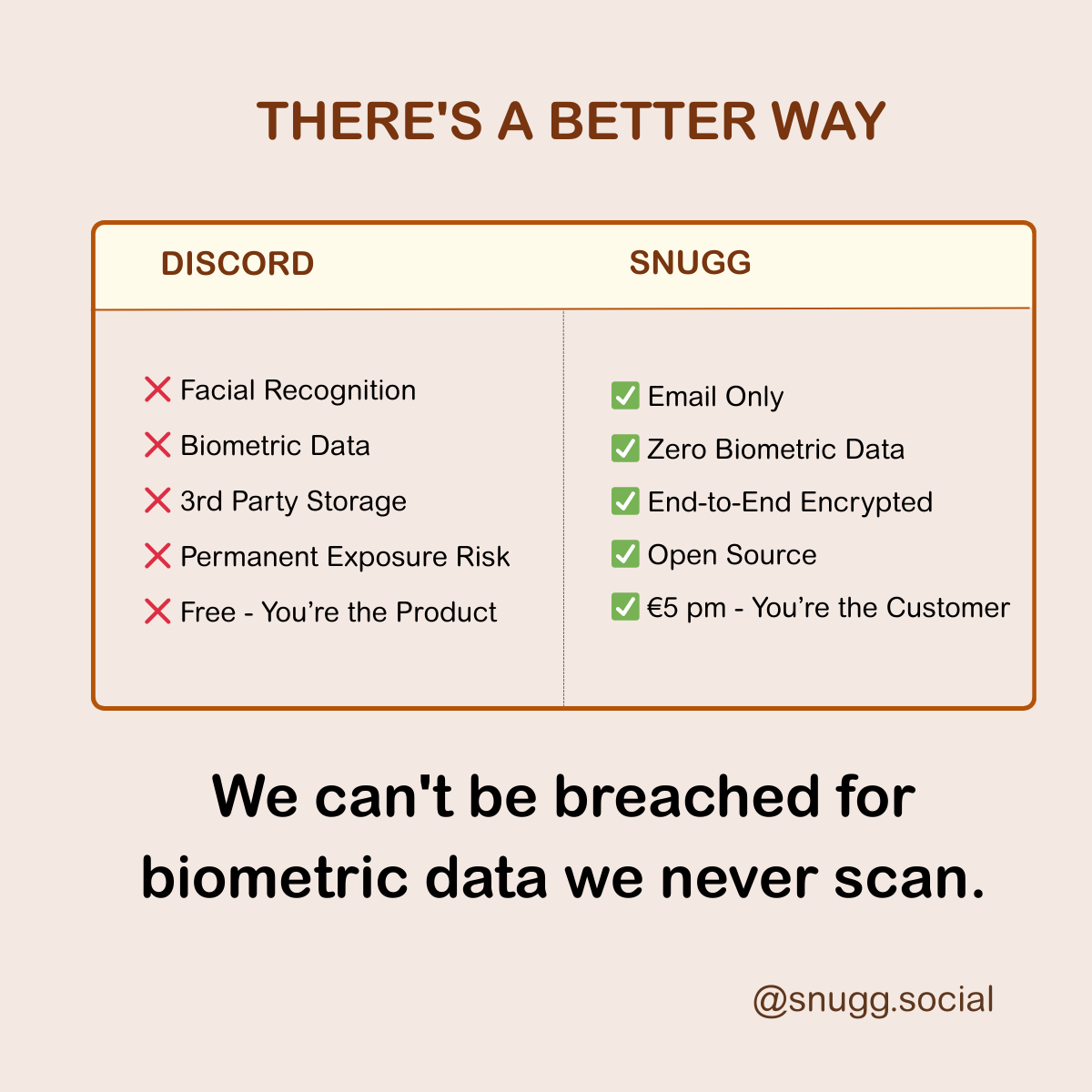

O que o Discord está realmente pedindo

O anúncio do Discord parece razoável na superfície.

"Para proteger adolescentes, os usuários devem verificar sua idade usando estimativa facial."

Deixa eu traduzir o que eles estão realmente pedindo.

Eles querem seu rosto. Um identificador biométrico irrevogável. Escaneado por uma empresa terceira chamada Yoti. Para uma verificação binária—maior de 18 ou não. "Processado brevemente e então deletado," eles dizem.

O que você ganha em troca?

Uso continuado de um aplicativo de chat.

O que você arrisca?

Exposição biométrica se algo der errado. Acesso de terceiros aos seus dados faciais—você não está apenas confiando no Discord, você está confiando na Yoti. Sem recurso se os dados forem mal administrados, porque você não pode mudar seu rosto. E talvez o mais importante: você está normalizando a prática. Aceitando que esta é uma troca razoável.

Aqui está o contexto que torna isso particularmente preocupante.

Esta é a mesma empresa cujo fornecedor de verificação de idade foi hackeado em setembro de 2025. O vazamento expôs 70.000 IDs governamentais. Cinco meses depois, eles estão implementando verificação facial global.

O Discord afirma que "esses fornecedores não estavam envolvidos" naquele vazamento. Mas eles agora usam múltiplos fornecedores. Não sabemos quais. Não conhecemos seu histórico de segurança.

Você está fornecendo identificadores biométricos para usar um aplicativo de chat de jogos.

A relação risco/recompensa não faz sentido.

Por que "anonimizado" não significa seguro

A defesa do Discord parece tranquilizadora.

"Os dados faciais são processados no dispositivo e nunca armazenados."

Vamos examinar o que isso realmente significa.

Seu rosto é escaneado. Características faciais são extraídas—geometria, distâncias, padrões. Um algoritmo estima sua idade. O Discord diz que a imagem é deletada.

Mas aqui está o que eles não estão te contando.

O processo ainda extrai características biométricas. Mesmo que a imagem original seja deletada, características foram extraídas e processadas. Pesquisas demonstram que embeddings faciais—representações matemáticas do seu rosto—podem ser usados para reconstruir rostos reconhecíveis.

"Processamento no dispositivo" nem sempre é no dispositivo. O Discord declara que o vídeo selfie é processado no seu dispositivo OU "processado brevemente pela Yoti e então deletado."

Esse "ou" importa.

Pesquisas recentes são preocupantes. Estudos demonstram que "rostos reconstruídos podem ser usados para acessar outros sistemas de reconhecimento facial do mundo real." Uma revisão abrangente sobre biometria inversa descobriu que técnicas de reconstrução foram "aplicadas a impressões digitais, íris, forma da mão, rosto e caligrafia."

A suposição de que "modelos biométricos não contêm informação suficiente para serem revertidos por engenharia reversa" está cada vez mais desatualizada.

Você tem que confiar na implementação. Quão forte é a deleção? Metadados são armazenados junto? O que acontece durante a transmissão? O código é proprietário—você não pode auditá-lo.

Vazamentos acontecem em cada estágio. Não se trata apenas do armazenamento final. Dados podem ser interceptados durante a captura. Durante a transmissão. Durante o processamento. Antes da deleção ser completada.

Um relatório de 2024 encontrou dezenas de vulnerabilidades em sistemas biométricos, incluindo uma onde atacantes podiam "acessar e alterar remotamente a base de dados biométrica da máquina" e "fazer upload de seu próprio rosto para o sistema."

O problema do precedente

"É apenas verificação de idade. Qual é o problema?"

O problema é o precedente.

Eu já vi esse padrão antes.

Primeiro, há uma justificativa razoável. "Precisamos verificar idade para proteger crianças." Quem vai argumentar contra isso?

Depois, escopo limitado. "Apenas para verificação de idade." "Apenas com seu consentimento."

Então, expansão do escopo. "Também para verificação de identidade." "Também para verificação de pagamento." "Também para acesso a conteúdo."

Então, requisito universal. "Para cumprir regulamentos..." "Por razões de segurança..." "Todas as contas devem verificar..."

E finalmente, vigilância normalizada. Reconhecimento facial é esperado. Toda plataforma exige. Você não pode participar sem se submeter.

Já vimos esse padrão com números de telefone. Começaram como "recuperação opcional." Agora exigidos para a maioria das plataformas.

Vimos isso com nomes reais. Começou como um experimento do Facebook. Agora é expectativa padrão.

Vimos isso com acesso à localização. Começou como "funcionalidade opcional." Agora muitos apps não funcionam sem.

Dados biométricos são a última fronteira.

Uma vez que normalizamos escaneamentos faciais para "verificação de idade," aceitamos que plataformas podem exigir credenciais biométricas irrevogáveis. Que terceiros podem processar nossos dados faciais. Que conveniência justifica riscos de segurança permanentes.

Se aceitamos aqui, toda plataforma seguirá.

O que você pode fazer

Você tem opções.

Não verificar. Mantenha sua privacidade biométrica. Sem risco de exposição permanente. Você envia um sinal de mercado—baixas taxas de verificação significam política ruim. Você pode perder acesso a algumas funcionalidades do Discord. Mas se você pode se dar ao luxo de perder acesso ao Discord, esta é a opção mais segura.

Verificar com escaneamento facial. Acesso completo ao Discord mantido. Mas seu rosto é processado por terceiros. Você normalizou a prática. Implicações de longo prazo desconhecidas. Só considere isso se o Discord é infraestrutura crítica para você E você entende os riscos.

Deixar o Discord. Proteção completa de privacidade. Vote com os pés—o sinal de mercado mais poderoso. Você precisa migrar comunidades e aprender novas plataformas. Mas se é viável, esta é a escolha de princípios.

Alternativas ao Discord

Se você está considerando sair, alternativas que respeitam a privacidade existem.

Para comunidades e grupos, eu recomendaria o Matrix / Element. Mensagens e voz/vídeo com criptografia de ponta a ponta. Descentralizado—nenhuma empresa o controla. Código aberto, então o código é auditável. Até tem uma ponte para o Discord para transição. Nenhum dado biométrico necessário. Gratuito.

O Revolt tem uma interface semelhante ao Discord se você quer algo familiar. Focado em privacidade. Auto-hospedável. Sem requisitos biométricos. Também gratuito.

Para mensagens privadas, o Signal continua sendo o padrão ouro. Criptografia de ponta a ponta incluindo metadados. Código aberto. Sem dados biométricos. Grupos de até 1.000 pessoas.

O Session é como o Signal mas descentralizado. Sem número de telefone necessário. Roteado por Onion para uma camada extra de privacidade.

Para comunidades sociais, o Mastodon oferece uma rede social descentralizada. Sem vigilância. Escolha seu servidor ou rode o seu próprio. Nenhum dado biométrico necessário.

Por que estou construindo o Snugg

1.000 pessoas compartilharam minha mensagem sobre dados biométricos.

Isso me ensinou algo importante. As pessoas sabem que vigilância é um problema. Elas não sabem que soluções existem.

Então deixe-me ser explícito sobre o que estamos construindo.

O Snugg nunca usará reconhecimento facial. Não agora, não nunca. Sem escaneamentos de impressão digital. Sem escaneamentos de íris. Sem impressões de voz. Sem dados biométricos de qualquer tipo.

O que usamos: apenas e-mail—revogável se comprometido. Nome de usuário opcional—pseudônimo por padrão. Sem número de telefone. Sem nome real a menos que você escolha compartilhar.

Por que podemos fazer isso?

Modelo de negócio.

Plataformas gratuitas precisam de publicidade. Publicidade precisa de vigilância para direcionar anúncios. Vigilância precisa de verificação de identidade. Verificação de identidade leva a requisitos biométricos.

O Snugg custa 5 euros por mês. Servimos usuários, não anunciantes. Não precisamos de vigilância. Não precisamos de identidade irrevogável.

Escolhemos um modelo de negócio que não requer seus dados biométricos.

Nunca coletaremos dados biométricos. Não para verificação. Não para segurança. Não para funcionalidades. Não para regulamentos. Nunca.

Não podemos abusar de dados que não coletamos. Não podemos vazar rostos que nunca escaneamos. Não podemos vender metadados que nunca capturamos. Não podemos treinar IA com dados que não temos.

Você é o cliente, não o produto. Modelo de assinatura significa que servimos você. Sem publicidade significa sem incentivo de vigilância. Sem venda de dados significa que seus dados continuam seus.

Código aberto significa auditável. O código será público. Você pode verificar nossas promessas. A comunidade pode inspecionar em busca de backdoors.

A lista de espera está aberta agora com mais de 3.000 membros. Lançamos em março de 2026. Os primeiros 500 ganham desconto vitalício de 40%—3 euros por mês para sempre.

A escolha

Reconhecimento facial obrigatório não é apenas um problema de plataforma.

É um precedente.

Se aceitamos que aplicativos de chat podem exigir identificadores biométricos irrevogáveis, aceitamos que todas as plataformas podem.

Sua senha vaza—você a muda. Seus dados biométricos vazam—você está comprometido. Para sempre.

A troca não faz sentido.

Estou construindo a alternativa. Redes sociais que nunca precisam ver seu rosto.

Porque não podemos vazar dados biométricos que nunca coletamos.

Junte-se aos membros fundadores →

Lançamento: Março de 2026 | Primeiros 500: Desconto vitalício de 40%

Leitura relacionada

- O Discord Quer Escanear Seu Rosto. Aqui Está Por Que Estou Preocupado. – Nossa análise detalhada do anúncio específico do Discord

- Comparação de Plataformas: Quais Apps Realmente Protegem a Privacidade

- Gratuito Não Significa Sem Custo: O Verdadeiro Preço das Redes Sociais

Fontes e Leituras Adicionais

Vazamentos de Dados Biométricos:

- Vazamento da Base de Dados BioStar 2 - The Register - Agosto 2019

- BioStar 2 Expõe 28 Milhões de Registros - Avast - Agosto 2019

- Lista Completa de Clientes da Clearview AI Roubada - CNN - Fevereiro 2020

- Vazamento de Dados da Clearview AI - WeLiveSecurity - Fevereiro 2020

- Análise do Vazamento de Dados Aadhaar - Huntress

- Falhas de Segurança do Aadhaar - Privacy International

- IDs Aadhaar Indianos na Dark Web - Resecurity - Outubro 2023

- Reconhecimento Facial do FBI: Relatório GAO - Junho 2019

- FBI Pode Pesquisar 400 Milhões de Fotos de Reconhecimento Facial - EFF - Junho 2016

Vulnerabilidades de Hash Biométrico:

- Reconstrução Facial a Partir de Embeddings Faciais - arXiv - 2026

- Reconstrução Facial Usando Modelos Adaptadores - arXiv - Novembro 2024

- Revertendo o Irreversível: Revisão sobre Biometria Inversa - arXiv - Janeiro 2024

Verificação de Idade do Discord:

- Anúncio das Configurações Teen-by-Default do Discord - Fevereiro 2026

- FAQ de Age Assurance do Discord - Suporte do Discord

- Como Completar Age Assurance no Discord - Suporte do Discord

- Vazamento de Dados do Discord: Hack do Fornecedor 5CA - Bitdefender - Outubro 2025

Grandes Vazamentos de Dados (Contexto):

- Acordo de Vazamento de Dados Equifax - FTC - 147,9 milhões de registros

- Vazamento de Dados Equifax 2017 - Wikipedia

- Vazamento de 3 Bilhões de Contas do Yahoo - BreachSense

Sobre o Autor

Sou perito em iates no Caribe e o fundador do Snugg. Depois de 15 anos assistindo plataformas de redes sociais priorizarem lucros sobre privacidade, decidi construir a alternativa. Não sou um ativista de privacidade—apenas alguém que pensa que você não deveria precisar escanear seu rosto para conversar com amigos.

Conectar: Twitter/X | LinkedIn | E-mail

Sobre o Snugg: Estou construindo a plataforma de redes sociais que eu gostaria que existisse. Sem anúncios. Sem rastreamento. Sem algoritmos. Sem vigilância. Apenas você, seus amigos e controle real sobre sua vida digital. Saiba mais

Se isso ressoou com você, por favor compartilhe. Quanto mais pessoas entendem o que está acontecendo, mais difícil é normalizar.